Actualidad

es que nos estamos rindiendo a ella

A medida que la inteligencia artificial se va integrando en nuestras vidas, hay una pregunta que va adquiriendo más relevancia. ¿Está la IA volviéndonos tontos? Quizás tontos no sea la palabra adecuada, sino más bien vagos, o al menos es la dirección en la que apunta un reciente estudio de la Universidad de Pensilvania.

Rendición cognitiva. Es como han llamado al fenómeno que surge cuando usamos la IA “con un escrutinio mínimo, anulando la intuición y la deliberación”. Los investigadores realizaron tres experimentos en los que los participantes debían responder tests de reflexión cognitiva, en los que la respuesta intuitiva tiende a ser errónea y la deliberada es correcta (preguntas trampa, vaya). Un grupo sólo podía usar su cerebro y el otro tenía acceso a ChatGPT, aunque estaba manipulado para que la mitad de las veces fallara a propósito.

El resultado fue que, cuando la IA daba una respuesta incorrecta, las personas la copiaban el 80% de las veces. Y lo que es peor: la seguridad de los participantes que tenían acceso a la IA era superior a pesar de estar acumulando respuestas incorrectas. Dicho de otro modo, los participantes hicieron suya la gran seguridad con la que la IA formulaba sus respuestas y dejaron de comprobar si eran correctas.

Un nuevo sistema . El estudio toma como punto de partida la teoría del sistema 1 y sistema 2 de Daniel Kahneman, en la que el sistema 1 es el pensamiento rápido o intuición y el sistema 2 es el pensamiento lento o deliberación. El problema de esta teoría, especialmente en el momento actual, es que ignora el hecho de que cada vez más estamos delegando el proceso cognitivo a la IA generativa. Por tanto, los investigadores proponen añadir un tercer sistema, al que han llamado “cognición artificial” y que hace referencia al pensamiento o razonamiento que ocurre fuera de nuestra mente, es decir, en la IA.

Rendirnos o delegar. El estudio hace una distinción entre la rendición cognitiva y la descarga cognitiva, es decir, no es lo mismo aceptar sin más lo que nos dice la IA, que usarla como una herramienta de ayuda. Lo primero sería usar el sistema 3 con un poco del sistema 1 (intuición), mientras que su uso como herramienta también implica el uso del sistema 2 (deliberación o razonamiento). Usar la IA para delegar ciertas tareas es comparable a usar una calculadora o buscar algo en Google. En el experimento, un 73% aceptó las respuestas equivocadas (se rindió) y un 17% la corrigió (delegó en ella, pero sin aceptar a ciegas lo que decía).

Los investigadores advierten que la rendición cognitiva puede erosionar el pensamiento crítico y hacer que perdamos la costumbre de desconfiar y comprobar las cosas por nosotros mismos.

La deuda cognitiva. En junio de 2025 se viralizó un estudio del MIT llamado “Tu cerebro en ChatGPT: acumulación de deuda cognitiva al utilizar un asistente de IA al escribir un ensayo”. En el experimento, monitorizaron a los participantes mediante encefalografía mientras realizaban la tarea. Los resultados fueron que el grupo que usó ChatGPT dio los peores resultados de actividad cerebral y se fue haciendo más perezoso conforme avanzaba la prueba.

La IA no nos hace tontos. A lo largo de los años han surgido muchos estudios que buscaban comprobar si la tecnología está mermando nuestras capacidades, pero también hay otros que apuntan a todo lo contrario. Volviendo al estudio del MIT, tiene sentido que haya menos actividad cerebral si estamos usando una herramienta de apoyo (y además una tan potente como la IA). También habrá menos actividad si usamos una calculadora que si hacemos las operaciones a mano, pero no significa necesariamente que seamos peores en matemáticas. Eso sí, si necesitamos la calculadora para sumar 2+2, ahí tenemos un problema.

La clave no está en si usar la IA nos hace tontos, sino en cómo la usamos, si nos rendimos a ella o si delegamos en ella.

Imagen | Andrea Piacquadio, Pexels

ues de anuncios individuales.

Source link

Actualidad

Alguien ha creado una IA que no sabe nada de lo que pasó después de 1930, y tiene más utilidad de la que parece

Uno de los problemas de los modelos de lenguaje es que hay una fecha de corte en los datos de entrenamiento, es decir, que el modelo no conoce hechos actuales que vayan más allá de esa fecha. Esto, que en ciertos sectores puede ser un problema grave, es precisamente el objetivo de Talkie-1930, un modelo de lenguaje entrenado únicamente con textos anteriores a 1930. Si alguna vez te has preguntado cómo sería hablar con alguien del pasado, hay una IA para eso.

Un modelo de lenguaje vintage. Así es como se ha bautizado a estos LLM que están entrenados con contenido histórico. Talkie-1930 es un modelo de 13.000 millones de parámetros que no tiene acceso a información moderna ni tampoco puede consultar en internet, sino que solamente ha sido entrenado con libros, periódicos y otros textos anteriores a 1930.

Para explorar el modelo, los investigadores pusieron a Claude a conversar con el modelo, evaluando sus respuestas. El modelo mostró un gran conocimiento del mundo, con muchos detalles históricos de la época, y una gran capacidad para imitar el estilo de autores victorianos como Dickens, aunque algo limitado en formatos más satíricos.

Más que un experimento cultural. Talkie es lo más parecido a hablar con alguien educado a principios del siglo XX. Esto convierte al modelo en una ventana que nos permite explorar la mentalidad y cultura de un tiempo pasado y conocer cómo se describían la sociedad, la política o la vida cotidiana de entonces. Pero más allá de la curiosidad, Talkie-1930 también funciona como un “sujeto de control” para estudiar mejor el funcionamiento de la IA y lograr avances importantes.

Prediciendo el futuro. Al estar “congelado” en 1930, Talkie permite medir mejor hasta dónde puede un modelo extrapolar y predecir el futuro solo a partir de patrones históricos, sin hacer trampa con datos posteriores. Para testear esa capacidad anticipatoria, los investigadores le mostraron hasta 5.000 descripciones de eventos históricos posteriores, tomadas de la sección “On this day” del New York Times, y midieron el grado de sorpresa del modelo.

El resultado fue que el modelo mostró más sorpresa en las décadas posteriores al corte de datos, especialmente en los 50 y los 60, pero después su grado de sorpresa se estabilizó. Según los investigadores, esto sugiere que el rendimiento predictivo va mejorando conforme el horizonte temporal es más largo, pero señalan que será necesario entrenar modelos más antiguos para poder medirlo bien.

Invención. Demis Hassabis, CEO de Google DeepMind, planteó una cuestión muy interesante en una conferencia hace poco: si una IA con un límite de conocimiento hasta 1911 podría llegar a la teoría de la relatividad que Einstein descubrió en 1915. En este sentido, modelos como Talkie-1930 son una herramienta muy interesante para observar su capacidad de generar nuevas ideas que puedan desembocar en descubrimientos.

Sin contaminación. Es uno de los problemas que tienen los modelos entrenados con grandes corpus de datos actuales, en los que suelen colarse también los propios datos de evaluación y acaba provocando que se sobreestimen sus capacidades. Con los modelos vintage no hay contaminación y eso permite poner en práctica experimentos muy concretos, como ver si es capaz de aprender a programar sin tener ningún tipo de conocimiento de informática previo. Talkie-1930 es de código abierto y está disponible en Github.

Imagen | Xataka

ues de anuncios individuales.

Source link

Actualidad

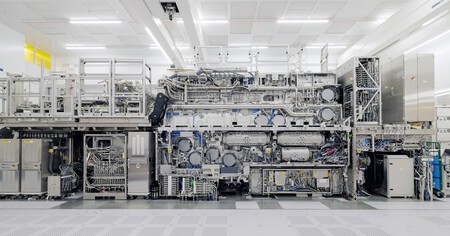

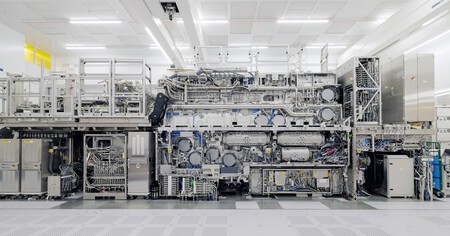

Fabricar 60 máquinas al año puede parecer poco. En la práctica, las de la europea ASML están marcando el ritmo de la IA

Sesenta máquinas al año suenan a poco cuando hablamos de inteligencia artificial. Estamos acostumbrados a cifras enormes: centros de datos, miles de millones de dólares y modelos cada vez más ambiciosos. Pero la IA también depende de cosas mucho más físicas y difíciles de escalar. Y ahí es donde ASML, una compañía europea que fabrica equipos de litografía para producir chips avanzados, se convierte en una pieza difícil de esquivar. Este año fabricará al menos 60 máquinas. Y serán indispensables.

Para hacernos una idea de la escala, la inteligencia artificial no se sostiene únicamente con mejores modelos. Hace tan solo nos días, Reuters señalaba que Microsoft, Meta, Amazon y Alphabet tienen previsto destinar más de 600.000 millones de dólares en gasto de capital en 2026 para ampliar su infraestructura de IA. Estos actores necesitan de los fabricantes de semiconductores, que necesitan tecnología avanzada para producir los chips que equiparán los futuros centros de datos de sus clientes.

Aquí aparece ASML en toda su dimensión. La compañía neerlandesa no fabrica los chips que acabarán en los centros de datos, pero sí las máquinas que permiten producir los más avanzados a escala. De momento, porque China está acelerando esta carrera, es el único proveedor mundial de esos equipos, conocidos como máquinas de litografía ultravioleta extrema. Esa posición explica por qué una empresa con sede en Veldhoven se ha convertido en una pieza tan relevante para una carrera que se suele mirar desde Silicon Valley o desde Taiwán, pero que también tiene un engranaje decisivo en Europa.

El fabricante europeo que marca el compás de la IA

Lo llamativo es que el gran salto se traduce en una cifra muy concreta. Los datos nos llegan desde la última presentación de resultados financieros de la firma, concretamente los del primer trimestre fiscal de 2026. Roger Dassen, VP y director financiero de ASML, señaló que prevén fabricar al menos 60 máquinas EUV estándar en 2026. Eso supone un 36% más que las vendidas en 2025. Dicho de otra forma: en una industria que se mide en inversiones gigantescas, aumentar de forma notable la producción significa pasar a decenas de equipos, no a cientos o miles. Para 2027, la firma espera poder alcanzar al menos 80 unidades.

TWINSCAN EXE:5000

Fabricar más unidades no es tan sencillo como ampliar una línea de montaje. Los equipos de litografía más avanzados de ASML tienen un tamaño comparable al de un autobús mediano y están entre los dispositivos más complejos que se han creado. Son sistemas enormes, extremadamente precisos y ensamblados durante meses en salas limpias, con aire purificado para evitar cualquier contaminación. La razón es sencilla: en este proceso, una sola partícula de polvo puede alterar la producción. Por eso escalar no depende solo de tener más pedidos sobre la mesa.

Hay una parte de esta historia que queda fuera de las fábricas de ASML, pero que pesa casi tanto como su propia producción. Sus clientes también necesitan construir salas limpias para instalar las máquinas que compran, una tarea que requiere obra especializada, conexiones eléctricas, experiencia técnica y abundante energía disponible. Es una condición básica para que esas decenas de equipos se traduzcan después en más capacidad real de fabricación. Dicho de otro modo: la máquina importa, pero también importa el lugar preparado para recibirla y ponerla a trabajar.

Luego está todo lo que ocurre antes de que uno de esos sistemas salga de la compañía neerlandesa. Sus equipos se construyen con componentes de más de 5.000 proveedores, así que aumentar el ritmo exige que toda esa red avance a la vez. Si uno de esos eslabones no llega, el conjunto puede resentirse. Y el talento añade otra dificultad: en el sur de Países Bajos, muchos perfiles técnicos ya están en la empresa o en su cadena de suministro. Por eso la firma de Veldhoven busca candidatos en universidades neerlandesas y extranjeras, sin debilitar a los socios que necesita para crecer.

Ese es el reverso de una cifra que, aislada, puede parecer pequeña. Sesenta máquinas no suenan a gran cosa en una industria que habla de modelos gigantescos, centros de datos y presupuestos descomunales. Pero lo que hemos visto es que cada una de esas unidades forma parte de una cadena física, técnica y humana mucho más difícil de acelerar de lo que parece. Este auge es precisamente el que ha ayudado a consolidar a ASML como la empresa europea con mayor valor bursátil, por delante de nombres como LVMH o Hermès. La IA también se juega aquí en el Viejo Continente.

En Xataka | ASML tiene las máquinas de litografía más demandadas y avanzadas del mundo. Y ahora también, su set de Lego

ues de anuncios individuales.

Source link

Actualidad

el uso compulsivo de internet

Durante décadas, la imagen de la rebeldía adolescente ha estado ligada al botellón, el tabaco a escondidas o el primer porro que se va tomando. Sin embargo, los jóvenes españoles en la actualidad están reduciendo bastante el consumo de estos productos, aunque para sustituirlo están optando por tener una adicción bastante compulsiva a internet o al scroll infinito en algunas aplicaciones como, por ejemplo, TikTok.

El declive del alcohol y tabaco. Los datos que nos dan una alegría con respecto a los consumos más nocivos entre nuestros jóvenes llegan de la encuesta ESTUDES 2025 que elabora el Ministerio de Sanidad a través del Plan Nacional sobre Drogas. Aquí se puede ver cómo, mientras en 1994 un 81,4% de los jóvenes den entre 14 y 18 años admitía haber probado el alcohol en alguna ocasión, ahora en 2025 esta cifra ha caído hasta el 73,9%, con un consumo en los últimos 30 días situado en el 51,8% de los casos.

Si nos centramos tanto en el alcohol como en el cannabis, también observamos mínimos históricos en el consumo en la franja de edad entre los 14 y los 18 años. Aunque el problema actual está centrado en los vapers de sabores o cigarrillos electrónicos que si que tienen una gran presencia en este grupo de edad frente a los intentos que se hacen para regularlo.

La nueva droga. Si nos quedáramos solo con esta mitad de la fotografía, podríamos pensar que los adolescentes de hoy son, simplemente, los más sanos de la historia. Pero aquí el mismo Ministerio de Sanidad, a través de otro informe de investigación, apunta a la relación de los jóvenes con la tecnología, que explica, en parte, por qué están menos tiempo en la calle haciendo botellón o probando el tabaco. De esta manera, se tienen varios datos importantes aquí:

- Un 19,4% de los estudiantes de 14 a 18 años presenta un uso problemático de internet.

- Un 15,3% muestra claros signos de problemas con las redes sociales, atrapados en mecánicas de diseño adictivo, que es lo que conocemos como doomscrolling.

- Un 5,2% presenta síntomas compatibles con la adicción a los videojuegos, algo que ha sido motivado también por las famosas ‘loot boxes’ que favorecen la adicción a los juegos de azar, ya que si buscan un cambio estético concreto, deben tener suerte para que les salga en una caja o un sobre virtual.

Tenemos un gran reto. Lo que nos dicen estos informes no es más que el problema que sufríamos en nuestra juventud ha mutado y se ha actualizado a otro mucho más moderno y difícil de detectar. Antes, el olor a tabaco era una señal clara de que algo estaba ocurriendo, pero hoy un adolescente puede estar desarrollando una adicción severa encerrado en su habitación, mientras sus padres piensan que solo “está con el móvil”.

Esto ha hecho que las políticas públicas estén centradas ahora mismo en este tipo de adicciones, también con algunas medidas que ya van sonando, como por ejemplo el veto al acceso a las redes sociales a menores de 16 años en nuestro país para controlar estas prácticas adictivas que las aplicaciones tratan de ir reforzando.

ues de anuncios individuales.

Source link

-

Tecnologia2 días ago

Tecnologia2 días agoNASA impulsará que Plutón vuelva a ser un planeta

-

Musica2 días ago

Musica2 días agoConciertos: Chesdana: música para enamorar

-

Tecnologia2 días ago

Tecnologia2 días agoMusk asegura en juicio contra OpenAI que fue engañado; “fuiste inspiración”, le dice Altman

-

Deportes2 días ago

Deportes2 días agoJuicio Maradona 2: Estaba hinchado, barbudo y con mal olor: Ex pareja | Video

-

Musica2 días ago

Musica2 días agoConciertos: La ciudad sube el volumen

-

Deportes2 días ago

Mundial 2026: Anuncian 18 ‘fan zones’ en la Ciudad de México | Video

-

Deportes2 días ago

Sanciona AMA a 291 atletas rusos tras investigación por dopaje institucionalizado

-

Musica2 días ago

Musica2 días agoMiércoles 2×1 en Superboletos: Lista de conciertos en Guadalajara que aplican HOY 29 de abril