Escrito en ENTRETENIMIENTO el

Actualidad

un motor para todas las velocidades

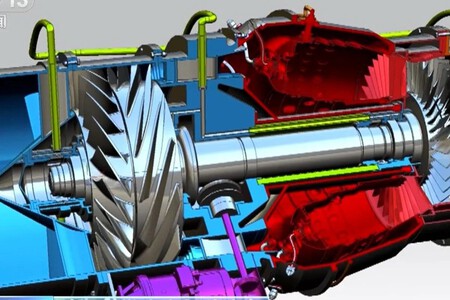

Durante décadas, el desarrollo de motores ha marcado un límite bastante claro de lo que un avión o un misil puede hacer en el aire. Alcanzar velocidades hipersónicas no depende solo de materiales o diseño aerodinámico, sino de resolver un problema mucho más complejo: cómo mantener un sistema de propulsión estable desde el despegue hasta más allá de Mach 6. China lleva trabajando en esa dirección desde mediados de los años noventa, y ahora afirma haber completado un prototipo que busca cubrir todo ese rango sin recurrir al cambio entre sistemas de propulsión en pleno vuelo.

Ese objetivo toma forma en lo que investigadores describen como un “contra-rotary ramjet engine”, un motor de respiración aérea concebido para operar de manera continua desde el arranque hasta velocidades superiores a Mach 6. El equipo, vinculado a la Academia China de Ciencias (CAS) y liderado por Xu Jianzhong, sostiene que el prototipo ya ha sido completado y verificado de forma experimental tras más de tres décadas de trabajo. Aun así, el desarrollo se encuentra en una fase preliminar: los siguientes pasos pasan por adaptarlo a distintas plataformas y someterlo a pruebas de vuelo reales que permitan validar su comportamiento fuera del laboratorio.

El motor que puede marcar un antes y un después en defensa

La solución tradicional al vuelo hipersónico y de alta velocidad suele combinar dos sistemas de propulsión: un motor de turbina para velocidades de hasta alrededor de Mach 3 y un ramjet para regímenes más altos. Por un lado, los motores de turbina cubren el despegue y las primeras fases del vuelo, mientras que los ramjet solo pueden funcionar cuando el aparato ya se desplaza a gran velocidad. Esta división del trabajo resuelve una parte del problema, pero introduce otras complicaciones. Según explican los investigadores, el sistema arrastra masa innecesaria cuando uno de los motores está inactivo y añade complejidad técnica en el momento de cambiar de régimen, un proceso que puede volverse inestable en fases exigentes del vuelo.

La propuesta del equipo chino introduce cambios en varios frentes, pero el núcleo está en su compresor. A diferencia de los diseños convencionales, emplea dos conjuntos de álabes que giran en sentidos opuestos, uno para alta presión y otro para baja presión, esta configuración reduce las fuerzas centrífugas sobre los componentes. También mejoraría la eficiencia de rotación. A ello se suma un planteamiento poco habitual: en lugar de minimizar las ondas de choque, el diseño las aprovecha para comprimir el flujo de aire, lo que reduciría su tamaño y peso.

El camino hasta este prototipo no ha sido rápido. Según recoge SCMP, Xu Jianzhong comenzó a centrarse en la propulsión hipersónica a mediados de los años noventa y ya hacia el año 2000 había perfilado el concepto de compresor de rotación contraria. Durante años, el proyecto avanzó hasta que en 2009 obtuvo respaldo institucional, lo que permitió construir plataformas experimentales desde cero. A partir de ahí, el equipo dedicó casi una década a resolver cuellos de botella técnicos, especialmente en el diseño de cascadas de álabes, antes de alcanzar la verificación experimental anunciada ahora.

Si esta arquitectura llegara a trasladarse a sistemas operativos, sus implicaciones serían directas en el diseño de aeronaves y misiles hipersónicos. Reducir el peso del motor en este tipo de armas abre la puerta a aumentar la cantidad de combustible, la carga útil o el alcance, además de mejorar la maniobrabilidad. En el caso de aeronaves reutilizables, un único sistema de propulsión simplificaría la integración y reduciría los riesgos asociados a los cambios de modo en pleno vuelo. Aun así, estas ventajas se plantean por ahora en términos potenciales, a la espera de validación en condiciones reales.

Pese al alcance del anuncio, el desarrollo se encuentra aún en una fase temprana si se mira desde el punto de vista operativo. Las pruebas realizadas hasta ahora se han limitado a entornos experimentales. El siguiente reto, según lo investigadores, será precisamente ese, adaptar el motor a aeronaves o misiles reales y comprobar su comportamiento fuera del laboratorio.

Imágenes | Xataka con Nano Banana | CAS

ues de anuncios individuales.

Source link

Actualidad

cuanto más calculamos el tamaño del Universo, menos sentido tiene todo

Hace tiempo que sabemos que el Universo se expande. Sin embargo, la velocidad a la que lo hace es un quebradero de cabeza. Según qué método se emplee para medirlo, se obtiene un resultado distinto. Ahora por fin se ha encontrado una forma mucho más precisa de medirlo, pero en realidad no deshace demasiado la maraña. La lía todavía más.

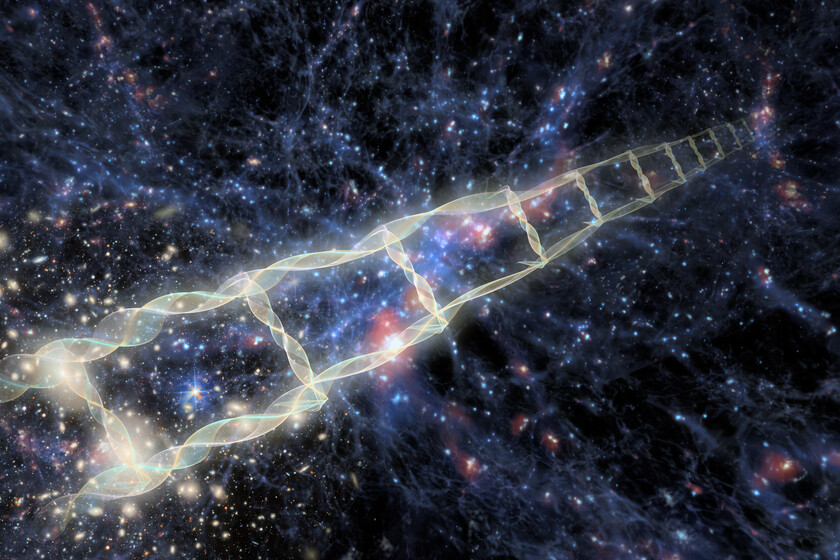

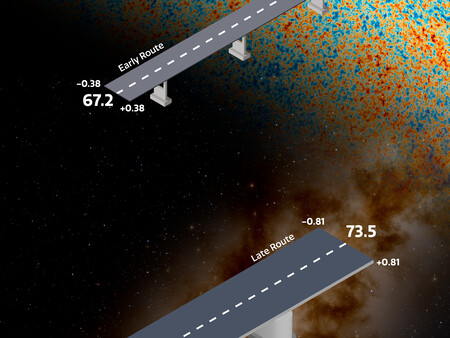

Una superposición de técnicas. Mediante una superposición de distintas técnicas, un equipo internacional de científicos ha hecho el cálculo más preciso hasta el momento de la velocidad de expansión del Universo: 73,5 ± 0,81 kilómetros por segundo por megaparsec. La cifra coincide bastante bien con las que se han calculado en el pasado tomando datos del Universo cercano. Sin embargo, se aleja bastante de la que se calcula cuando se emplean datos de los albores del Universo. Esto indica que hay algo en la física de ese punto más alejado del cosmos de lo que no tenemos ni idea. Lejos de resolverse, el misterio se ha complicado.

Un globo que se infla. Cuando hablamos de que el Universo se expande, hacemos referencia a que las galaxias están cada vez más alejadas unas de otras. Pero no porque las propias galaxias se muevan, sino porque el espacio que hay entre ellas se ensancha. Podemos verlo como un globo en el que se pintan una serie de puntos. A medida que el globo se infla, los puntos se ven más alejados, a pesar de que no se han movido de su sitio.

Tensión de Hubble. Tradicionalmente, la velocidad de expansión del Universo se calcula de dos formas. O midiendo las distancias entre las estrellas y galaxias del Universo cercano, o midiendo el fondo cósmico de microondas. Esta es la radiación electromagnética que quedó como remanente del Big Bang. Es decir, la luz más antigua que podemos encontrar en el Universo, pues se formó en la explosión con la que este se formó. Por lo tanto, los datos no se toman del Universo cercano, sino del más lejano y antiguo, el que se acerca al Big Bang.

La cifra obtenida con ambos tipos de cálculos debería ser la misma. Sin embargo, con el Universo cercano se obtiene una velocidad de 73 kilómetros por segundo por megaparsec, mientras que con el Universo más lejano se calcula una velocidad de 67 kilómetros por segundo por megaparsec. Esta incoherencia se conoce como tensión de Hubble e indica que, posiblemente, el Universo se expande cada vez más deprisa. Por eso el más cercano se expande más rápido.

Este gráfico representa la tensión que existe entre las mediciones de la tasa de expansión del Universo tardío y cercano, frente a lo que se esperaría basándose en mediciones del Universo primitivo, específicamente el fondo cósmico de microondas

Podría ser un error. Una de las hipótesis que buscan explicar la tensión de Hubble es que, en realidad, hay algún error al medir la velocidad de expansión en el Universo cercano. Existen muchos métodos para calcular la distancia entre estrellas y galaxias y podría ser que hubiese un error. Por eso, un equipo internacional de científicos ha decidido usar una superposición de técnicas para hacer un cálculo más preciso.

Distintos tipos de estrellas. Este método consiste en analizar simultáneamente una gran cantidad de datos obtenidos de telescopios terrestres y espaciales. Estos se centran principalmente en el brillo de estrellas cefeidas, gigantes rojas, supernovas y galaxias de brillo conocido. Los tres tipos de estrellas mencionadas se caracterizan por tener un brillo característico, que sirve para mapear el Universo y, por lo tanto, también para calcular distancias. Con esta superposición de técnicas se obtuvo la cifra de 73,5 ± 0,81 kilómetros por segundo por megaparsec.

No hay error. Cuando se eliminaba uno de los métodos de la superposición, la alteración de la velocidad de expansión del Universo era mínima. La cifra era prácticamente la misma. Esto indica que el número se ha medido perfectamente. No hay un error. Entonces, si la tensión de Hubble no se debe a un error, ¿por qué se produce?

Continúa el misterio. Tras obtener estos resultados, la tensión de Hubble sigue siendo la antesala de un misterio. No obstante, sí que es cierto que existen algunas hipótesis. Por ejemplo, se cree que las distintas cifras en el Universo lejano y cercano pueden deberse a la intervención de la materia oscura. Hay mucho que no sabemos sobre ella, por lo que quizás podría explicar lo que está ocurriendo. Por otro lado, existe la hipótesis de que la Tierra está en un lugar con características espaciales. Sería una zona donde hay relativamente poca materia, comparable a una burbuja de aire en un pastel.

Como explicó en 2023 uno de los científicos que apoyan esta hipótesis, Indranil Banik, “la densidad de la materia es mayor alrededor de la burbuja, de modo que las fuerzas gravitatorias emanan de esta materia circundante, atrayendo a las galaxias de la burbuja hacia los bordes de la cavidad”. “Por eso se están alejando de nosotros más rápido de lo que realmente cabría esperar”. Ahora habrá que resolver esa parte del misterio. Al menos sabemos que no hay un error en los cálculos y que la tensión de Hubble es una realidad.

Imagen | CTIO/NOIRLab/DOE/NSF/AURA/J. Pollard

En Xataka | Refutar a Einstein es uno de los grandes retos de la física. Ni cambiando de escala lo logramos

ues de anuncios individuales.

Source link

Actualidad

Luto en el rock en español: muere Felipe Staiti, guitarrista de “Enanitos Verdes”

La noche de este lunes se confirmó el fallecimiento del guitarrista Felipe Daniel Staiti, fundador de la banda de los “Enanitos Verdes”.

La información fue confirmada por la agencia WR Producciones, que despidió al guitarrista con un mensaje en redes sociales.

“Su talento, entrega y pasión por la música dejaron una huella imborrable en generaciones enteras y en la historia del rock en español”, se lee.

La empresa expresó sus condolencias a la familia, amigos, cercanos y seguidores de Felipe Staiti; “su música vivirá para siempre”, añadió.

Hasta el momento se desconocen las causas del fallecimiento; seguidores, amigos y conocidos han lamentado la muerte del guitarrista.

“Vuela alto, Felipe, que tu música siga resonando donde habita lo eterno, y que Dios te reciba en su gloria”, escribió Beto Cuevas.

Su partida ocurre más de tres años después de la muerte de otro de lo integrantes de la banda, el vocalista Horacio “Marciano” Cantero.

“Enanitos Verdes” nació en la ciudad de Mendoza, Argentina, en noviembre de 1979, con Marciano Felipe y Daniel Piccolo en batería.

En 1994 estrenaron su álbum Big Bang, el cual contenía su más sonado éxito “Lamento boliviano”. Su primer disco, Contrarreloj, se estrenó en 1986.

ues de anuncios individuales.

Source link

Actualidad

Creíamos que los centros de datos en el espacio eran cosa del futuro. Kepler ya ha activado el mayor clúster orbital

Durante años, hablar de centros de datos en el espacio sonaba a esa clase de idea que siempre parecía estar a unos cuantos años de distancia. La conversación existía, desde luego, pero casi siempre apoyada en planes a largo plazo, anuncios ambiciosos y una industria que todavía no había enseñado demasiado músculo real en órbita. Por eso lo que acaba de emerger merece atención. TechCrunch explica que Kepler Communications ya ha puesto en marcha el mayor clúster de computación hoy operativo en el espacio, una señal de que esta carrera empieza a abandonar el terreno de la promesa para entrar, poco a poco, en el de la infraestructura.

Qué ha puesto Kepler en órbita. No es una gran instalación suspendida sobre nuestras cabezas, sino un clúster distribuido compuesto por 10 satélites operativos. Entre todos suman alrededor de 40 procesadores Nvidia Orin orientados a Edge Computing, conectados entre sí mediante enlaces láser. Ese conjunto, lanzado en enero de este año, como decimos, es hoy el mayor clúster de computación activo en órbita. Desde la propia compañía, además, encuadran esa red como una constelación diseñada para mover datos en el espacio casi en tiempo real.

Lo que realmente es. Así que no estamos ante un centro de datos orbital masivo que replique el modelo terrestre, sino ante una arquitectura distribuida que combina conectividad y procesamiento en pleno entorno espacial. Esa diferencia importa porque nos permite separar dos planos que a menudo se mezclan: una cosa es la visión de gran escala que defienden actores como SpaceX o Blue Origin, y otra muy distinta es este primer paso, mucho más pegado a usos inmediatos y necesidades concretas de las misiones en órbita.

El negocio inmediato. Si esta computación orbital empieza a resultar interesante, es porque ataca un problema bastante claro: no siempre tiene sentido enviar todos los datos a la Tierra para procesarlos después. El valor inicial de estos sistemas está en trabajar con la información allí mismo donde se genera, algo especialmente útil para sensores más avanzados y para aplicaciones que exigen una respuesta más rápida. Kepler sostiene además que su red puede servir como base para futuros servicios de procesamiento y conectividad entre distintos activos espaciales, y el medio añade que la compañía ya transporta y procesa datos subidos desde tierra, así como información recogida por cargas útiles alojadas en sus propios satélites.

Sophia Space. Aquí entra en escena una startup que quiere subir su sistema operativo propietario a uno de los satélites de la constelación e intentar desplegarlo y configurarlo sobre seis GPU repartidas en dos naves. En un centro de datos terrestre eso sería casi rutina, pero sería la primera vez que veríamos algo así en órbita. Para Sophia, además, la prueba tiene un valor claro de reducción de riesgo antes de su primer lanzamiento previsto para finales de 2027. Y no hablamos de un detalle menor: la compañía está desarrollando ordenadores espaciales con refrigeración pasiva, una vía con la que busca atacar uno de los grandes problemas de este sector: evitar el sobrecalentamiento.

Kepler no quiere ser eso. En medio de tanto ruido alrededor de los centros de datos orbitales, la propia empresa intenta situarse en un lugar algo distinto del mapa. Su presentación corporativa insiste en una misión mucho más ligada a las comunicaciones, con una constelación óptica híbrida diseñada para modernizar el flujo de datos en órbita baja y más allá. En este sentido, no se defina a sí misma como una compañía de centros de datos, sino como infraestructura para aplicaciones espaciales.

El viaje ha comenzado. Si algo deja claro este paso de Kepler es que la computación orbital ya no pertenece solo al terreno de las grandes presentaciones. SpaceX quiere desplegar una red masiva de satélites para IA, Google prepara pruebas en órbita con chips alimentados por energía solar y Blue Origin ha anunciado una constelación de más de 5.000 satélites. En paralelo, Starcloud ya lanzó en 2025 un satélite con una GPU Nvidia H100 y Aetherflux apunta a 2027 para su primer nodo.

Imágenes | Kepler Communications | Sophia Space

ues de anuncios individuales.

Source link

-

Actualidad1 día ago

Actualidad1 día agoMéxico está metiendo la patita en la industria de los semiconductores. Hará falta algo más que buenas intenciones

-

Deportes22 horas ago

Deportes22 horas agoFMF y RFEF firman un acuerdo de colaboración | Video

-

Deportes1 día ago

Deportes1 día agoMarie-Louise Eta, primera en dirigir a un equipo varonil de la Bundesliga

-

Actualidad2 días ago

Actualidad2 días agoYa sabemos a dónde van a parar muchos de los microplásticos que entran en nuestro organismo. Tenemos malas noticias

-

Actualidad2 días ago

Actualidad2 días agoun barco se mueve a la velocidad de una bicicleta

-

Actualidad22 horas ago

Actualidad22 horas agoUna familia quiso vivir solo con paneles solares, agua de pozo y un huerto. Hasta que Italia le quitó a sus hijos

-

Musica24 horas ago

Musica24 horas agoConciertos: Un idioma llamado tap

-

Actualidad2 días ago

Actualidad2 días agoFallece la cantante Asha Bhosle, la voz de Bollywood y la intérprete con más grabaciones en la historia de la música