Actualidad

NVIDIA no lanzará nuevas gráficas este año, según The Information

Ser jugador de PC se parece hoy más a una prueba de paciencia que a un simple hobby. Tras años marcados por precios disparados y escasez, el auge de la inteligencia artificial ha añadido una nueva capa de tensión al mercado del hardware. La memoria se ha convertido en un recurso especialmente disputado y sus efectos ya no se limitan a centros de datos o grandes empresas: empiezan a sentirse directamente en el ecosistema del juego, justo donde los usuarios esperaban, al menos, cierta estabilidad.

Qué está pasando. Las dudas actuales parten de una cadena de informaciones que conviene situar con precisión. The Information señala que NVIDIA no tiene previsto lanzar nuevas tarjetas gráficas GeForce para juegos en 2026, una decisión que esa fuente vinculan a la escasez de memoria que atraviesa la industria. No se trata, en cualquier caso, de una confirmación pública de la compañía, pero proviene de dos personas con conocimiento del tema que hablaron con el mencionado medio en condición de anonimato.

Lo que dice NVIDIA. El fabricante estadounidense no se ha quedado completamente en silencio. De hecho, en declaraciones a Tom’s Hardware, ha dejado ver parte del problema: “La demanda de GPU GeForce RTX es alta y la oferta de memoria es limitada. Seguimos enviando todos los SKU de GeForce y colaboramos estrechamente con nuestros proveedores para maximizar la disponibilidad de memoria”.

Entendiendo los lanzamientos. La cadencia histórica de NVIDIA combina dos ritmos distintos que conviene separar. Por un lado están los cambios de arquitectura, espaciados en el tiempo y asociados a saltos claros de rendimiento o funciones. Por otro, las versiones intermedias que refinan lo existente mediante ajustes de memoria, consumo o frecuencias, manteniendo viva la gama. Esa estrategia híbrida explica por qué percibimos una presencia anual constante de nuevas tarjetas incluso cuando la base tecnológica permanece intacta.

La mejor forma de entender esa cadencia es mirar lo ocurrido en los últimos años, con cambios de arquitectura cada 2-3 años y refrescos o ampliaciones el resto del tiempo.

Bajo ese patrón, lo esperable para 2026 era precisamente otro refresco intermedio de la serie RTX 50, el que ahora está en duda.

El componente que realmente fija el ritmo. La discusión sobre nuevas tarjetas suele centrarse en la potencia del chip gráfico, pero el cuello de botella actual parece situarse en otro punto de la cadena. NVIDIA acostumbra a proporcionar a sus socios un conjunto completo que combina GPU y memoria, de modo que la falta de módulos GDDR7 suficientes impide cerrar ese paquete y, por tanto, distribuir nuevas unidades. Bajo esa lógica industrial, la escasez de memoria deja de ser un problema secundario y pasa a convertirse en un factor determinante.

Memoria para los centros de datos. La mencionada limitación material no aparece en el vacío, sino en un momento en el que la industria tecnológica está reordenando prioridades alrededor de la inteligencia artificial. Los centros de datos dedicados a entrenar y ejecutar modelos avanzados demandan enormes volúmenes de memoria y comparten, en buena medida, las mismas cadenas de suministro que el hardware de consumo. Cuando esa presión aumenta, los recursos disponibles tienden a desplazarse hacia el segmento empresarial.

Buscando la normalidad. Con el presente condicionado por la memoria disponible, la gran incógnita pasa a ser cuándo llegará el verdadero relevo generacional. De acuerdo con la información recogida por Tom’s Hardware, la hoja de ruta interna situaría la producción masiva de las RTX 60 más allá de 2027, lo que podría desplazar su llegada efectiva al mercado hacia 2028. No existe confirmación directa de NVIDIA sobre estas fechas, de modo que conviene tratarlas como estimaciones procedentes de fuentes familiarizadas con la planificación.

Imágenes | Xataka

ues de anuncios individuales.

Source link

Actualidad

la ciencia explica por qué tu cerebro prefiere el papel al teclado para aprender

En una era dominada por teclados mecánicos, pantallas táctiles y tablets de última generación, el gesto ancestral de deslizar un bolígrafo sobre el papel parece un anacronismo reservado para las personas que no se han actualizado. Y esta es una realidad en ámbitos de estudios como, por ejemplo, las universidades, donde ya es raro ver a alguien estudiar a mano. Pero la realidad es que, para ser mucho más productivos estudiando, puede que lo mejor sea dejar el portátil de lado y comenzar a escribir.

La ‘magia’ del bolígrafo. Aquí la ciencia, en sus diferentes disciplinas, ha llegado a la conclusión de que tomar notas a mano mejora significativamente la retención y la comprensión en comparación con usar de manera activa los dispositivos digitales. Y no es una cuestión de romanticismo, es una cuestión de procesamiento neuronal.

Un efecto de transcripción. Uno de los pilares de esta evidencia está en un estudio publicado en 2014 que apuntó a que los estudiantes que usan portátiles para tomar notas se convierten en auténticos transcriptores de lo que dice el profesor. Y es que hemos llegado al punto en que muchas personas pueden escribir más rápido de lo que hablan los profesores y se convierten en “máquinas de transcribir” sin procesar la información y quedarse con lo más importante. Incluso he visto que hasta los chascarrillos se terminan copiando.

Por el contrario, quien escribe a mano no puede anotarlo todo. Esto le obliga a realizar un procesamiento cognitivo activo: debe escuchar, digerir, sintetizar y reformular la idea en sus propias palabras. Esta “dificultad deseable” genera una codificación mucho más profunda en la memoria que perdura incluso una semana después del estudio.

Mejor el papel. Más allá del efecto transcripción, la neurociencia ha confirmado que el beneficio no es solo estratégico, sino físico. Aquí, un estudio del 2021 publicado por la Universidad de Tokio demostró mediante electroencefalogramas que escribir a mano activa áreas cerebrales críticas para la memoria, el lenguaje y el movimiento fino.

Es por ello que, al usar un bolígrafo, se ha visto que se activa bastante el hipocampo, que es fundamental para la memoria y la codificación espacial de la información. Pero no se queda aquí, puesto que se ha detectado hasta un 25% más de conectividad neuronal en tareas complejas cuando se usa el método analógico. Esto explica por qué estudiantes de carreras de alta exigencia suelen rendir mejor cognitivamente cuando optan por métodos neuronales como las ingenierías.

Menos distracciones. Más allá de las neuronas, el papel ofrece una ventaja competitiva en el entorno de estudio, ya que es un sistema cerrado. Esto es muy importante porque una tablet o un portátil no deja de ser también una herramienta con puertas abiertas a notificaciones, redes sociales y apps de mensajería que puede ser una tentación a la hora de interrumpir el estudio con bastante facilidad.

Además, facilita el reconocimiento de palabras y la memorización visual, algo vital para oposiciones o exámenes de alto nivel como una oposición. Y aunque las notas digitales con un buen diseño pueden ser superiores para poder recordar un dato suelto rápidamente, el papel gana por goleada en la comprensión conceptual.

Imágenes | yanalya en Magnific

ues de anuncios individuales.

Source link

Actualidad

Anthropic no ofrece sus servicios en China. Así que China se ha inventado un mercado negro de tokens de Claude

Claude se ha convertido en el modelo más deseado por los desarrolladores e ingenieros más exigentes, pero no está disponible en China continental por motivos regulatorios y de seguridad. Allí la demanda sigue siendo notable, y para satisfacerla ha surgido una economía sumergida de tokens que permite a los desarrolladores locales acceder a modelos como Claude Opus 4.7 esquivando todas las medidas impuestas por el bloqueo.

Nada de pagar con Alipay. Una de las medidas que impone Anthropic para evitar el uso de sus modelos en China es aceptar únicamente tarjetas de crédito internacionales como Visa o Mastercard. Sus pasarelas de pago rechazan métodos de pago locales como Alipay o Wechat Pay, lo que hace que los usuarios chinos tengan un primer e importante obstáculo. Uno que ya han superado.

Tarjetas virtuales. Lo que están haciendo en China para superar ese problema es usar tarjetas de crédito virtuales (VCC) como DuPay o WildCard. Con estos servicios es posible conseguir tarjetas de crédito de Hong Kong o de EEUU financiadas con criptomonedas o mediante transferencias locales. Eso hace posible engañar a los sistemas de facturación de Anthropic y de otras empresas que ofrecen servicios vetados a los usuarios chinos. Las verificaciones mediante SMS también están solucionadas mediante “granjas SMS” que evitan también este problema e incluso otros como la verificación de identidad que también han implementado en Anthropic.

Llegan las “Estaciones de transferencia” (中转站). Otro problema está en que aun superando esa primera barrera, la latencia y los microcortes hacen que el uso de Claude en China se vea afectado por continuos problemas de conexión. Para evitarlos han surgido las llamadas “Estaciones de transferencia”, que no son más que servidores que actúan como un puente entre los servidores extranjeros y los usuarios chinos. Estas pasarelas reciben las peticiones de China y las reenvían a los servidores de Anthropic como si procedieran de una ubicación autorizada. Las latencias son además relativamente bajas, lo que hace que para los usuarios chinos la experiencia sea básicamente idéntica a la de un usuario en EEUU o en España, por ejemplo. Estas estaciones se conocen públicamente y no solo aparecen en listados en GitHub: hay un ranking con las mejores.

Claude sale casi gratis en China. Lo sorprendente de estos métodos es que no solo dan acceso a Claude en China: lo hacen con precios ridículos que llegan a ser el 10 e incluso el 5% del (cada vez mayor) precio original del servicio gracias a esas estaciones de transferencia. La pregunta, por supuesto, es cómo es posible acceder a Claude a esos precios.

El truco del almendruco. racias a las estaciones de transferncia, los desarrolladores logran acceder a Claude a un precio de 1 yuan por cada dólar de tokens, o lo que es lo mismo, hasta un 90% de reducción del precio oficial. Es algo que se comenta públicamente y que deja claro que para lograrlo se usan varios métodos:

- Compra masiva de capacidad,

- Uso de cuentas creadas con tarjetas robadas o fraudulentas,

- Uso de créditos promocionales, y

- Un simple anzuelo: los proveedores pierden dinero con Claude, pero logran atraer desarrolladores a los que luego les venden modelos locales más rentables como DeepSek.

¿Estoy usando realmente Claude? Uno de los riesgos crecientes en el mercado de tokens baratos es el fraude directo. Algunos revendedores chinos han sido cogidos con las manos en la masa ofreciendo lo que ellos llaman la “Claude API” cuando en realidad lo que estaban proporcionando era modelos mucho más baratos y mediocres. Que un usuario detecte este tipo de engaño es muy difícil salvo que esté trabajando con tareas complejas o que ya haya usado modelos y sepa más o menos qué esperar de ellos. Para las víctimas el efecto es claro: creen estar pagando por la inteligencia de Opus 4.7 cuando en realidad están recibiendo respuestas de un modelo de IA de gama baja.

Adiós a la privacidad. Cuando un usuario compra tokens en una de estas estaciones de transferencia, renuncia completamente a la confidencialidad de sus datos. Todas las consultas y las respuestas acaban pasando por los servidores del intermediario, que puede utilizarlas —y al parecer, lo hace— para vendérselas a empresas de IA que las usen para el post-entrenamiento de sus modelos. Así pues, todo lo que hacen y dicen al usar estos modelos se filtra y se usa como datos de entrenamiento sin que el usuario se entere.

Un negocio doble. Para estos proveedores ese negocio de revender conversaciones es especialmente interesante de cara a las famosas “destilaciones” de modelos de EEUU que se aprovechan de esos datos para “copiar” las capacidade s de esos modelos y aplicarlas a modelos chinos.

Anthropic nos puede leer, pero (teóricamente) no lo hace. Es cierto que las conversaciones que mantenemos con Claude (desde España, por ejemplo) también se almacenan en los servidores de Anthropic, pero la empresa deja claro en su política de privacidad que no usa esos datos. De hecho, hasta podemos prohibir explícitamente que la empresa los use en las opciones de privacidad de la cuenta de Claude.

El juego del gato y el ratón. En Anthropic saben muy bien lo que está pasando y están tratando de evitarlo. Por ejemplo, han comenzado a bloquear de forma intensiva rangos de IPs asociados a servicios VPN o centros de datos conocidos por ser usados en esas estaciones de transferencia. Aun así, los proveedores chinos suelen responder con una arquitectura “elástica” que permite ir rotando IPs de residencias domésticas, haciendo que el tráfico parezca totalmente normal.

Imagen | Xataka con Magnific

ues de anuncios individuales.

Source link

Actualidad

Corning tiene la solución para acelerar aún más los chips de Nvidia

Hay buenas razones por las que una compañía de la talla de Nvidia querría colaborar con una empresa como Corning, especialistas en fabricar el cristal que protege nuestros teléfonos móviles. Corning ofrece más productos aparte de su Gorilla Glass, y es eso precisamente por lo que la compañía de Jensen Huang está interesada. Y es que Nvidia va a invertir unos 3.200 millones de dólares en el fabricante de vidrio con la intención de multiplicar por diez la capacidad productiva de conectividad óptica en suelo estadounidense.

Lo que hay sobre la mesa. El alcance financiero del acuerdo se ha ido desvelando por partes. Inicialmente se anunció que Nvidia recibiría warrants (derechos de compra de acciones) para adquirir hasta 15 millones de títulos de Corning a un precio de 180 dólares por acción, lo que representa una inversión potencial de hasta 3.200 millones de dólares. A eso se suma un warrant prefinanciado por otros 500 millones adicionales.

Pero el CEO de Nvidia confirmó en CNBC que la empresa también ha realizado “un prepago de varios miles de millones de dólares” para financiar la construcción de las nuevas fábricas, una cifra que no formó parte del anuncio oficial inicial y cuyo importe exacto tampoco se ha hecho público.

De fibra óptica va la cosa. Los centros de datos que alimentan la IA albergan cientos de miles de GPUs que deben comunicarse entre sí de forma continua y a gran velocidad. Durante décadas, esa comunicación se ha realizado mediante cables de cobre, y de hecho para conexiones de corta distancia dentro del rack (del servidor al switch), se siguen usando, pero la fibra óptica acaba siendo superior en todo, tanto por velocidad como por consumo energético y menor pérdida de señal.

Lo que Nvidia tiene en mente. El término técnico que está en el centro de este acuerdo es co-packaged optics (óptica cointegrada), que viene a referirse a la integración de fibra de vidrio directamente dentro de los sistemas de chips, sustituyendo progresivamente los cables de cobre. En el interior de los sistemas de racks de Nvidia (como el Vera Rubin) hay actualmente unos 5.000 cables de cobre que podrían ser reemplazados por fibra óptica de Corning.

Ya en la GTC del año pasado, Huang calificó esta tecnología de “esencial para el despliegue de la IA”. La compañía lleva meses preparando el terreno: en marzo invirtió 4.000 millones de dólares en Coherent y Lumentum, dos empresas especializadas en los láseres y componentes que convierten datos entre señales de luz y eléctricas, que luego viajan por los cables de fibra de Corning.

Quién más está en la carrera. Nvidia no es la única que apuesta por esta tecnología. Sus competidores Broadcom y Marvell ya han lanzado productos similares, e Intel también desarrolla sus propias soluciones de óptica cointegrada. Por su parte, Corning ya tenía a Meta como cliente de referencia. De hecho, la compañía de Zuckerberg anunció un acuerdo de hasta 6.000 millones de dólares para que Corning amplíe su planta de cables ópticos en Hickory, Carolina del Norte. La alianza con Nvidia añade ahora tres instalaciones más y multiplica por diez la capacidad de fabricación de conectividad óptica de la compañía en Estados Unidos, además de incrementar en más de un 50% su producción de fibra.

“Made in America”. El acuerdo llega precisamente en un momento en que la administración Trump está presionando para relocalizar cadenas de suministro tecnológicas que durante décadas se han construido en Asia (Taiwan, China o Vietnam). Huang contaba a la CNBC que “es una oportunidad extraordinaria para reinvertir y revitalizar la fabricación americana por primera vez en varias generaciones.”

Según el CEO de NVIDIA, el sector tech no sería el único beneficiado, pues la construcción y operación de estos centros de datos genera demanda de electricistas, trabajadores de la construcción, operarios de fabricación de chips y especialistas en infraestructura. “La escasez de trabajadores cualificados y la demanda son increíblemente altas”, mencionaba Huang al medio.

Empresa reconvertida. Corning se ha convertido en otra de esas compañías que han visto beneficiado su negocio gracias al boom de la IA. Y es que la firma acumula una subida superior al 300% en el último año, impulsada por su reposicionamiento hacia el mercado de la IA y alejándose de su imagen más conocida como fabricante del vidrio de las pantallas de móviles.

En Xataka | Si la pregunta es si usar ChatGPT o Claude en inglés es más eficiente y ahorra tokens, la respuesta es: yes

ues de anuncios individuales.

Source link

-

Deportes2 días ago

Deportes2 días agoLos once de la tribu (fragmento) | Texto de Juan Villoro

-

Musica2 días ago

Musica2 días agoConcierto GRATIS este 10 de mayo para celebrar el Día de las Madres 2026

-

Tecnologia2 días ago

Tecnologia2 días ago10 gadgets imperdibles para este Día de las Madres

-

Tecnologia2 días ago

Tecnologia2 días agoUn anillo inteligente que marca el futuro de los wearables

-

Deportes2 días ago

Deportes2 días agoBarcelona vence 2-0 a Real Madrid y se regala un clásico que vale una Liga

-

Musica1 día ago

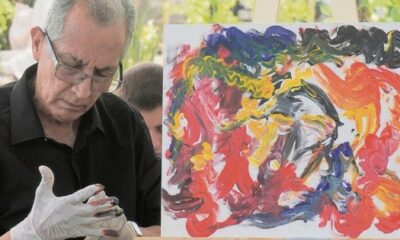

Musica1 día agoArtes: Javier Jiménez y el arte de pintar la música

-

Tecnologia21 horas ago

Tecnologia21 horas agoSuperficie forestal mundial se redujo en 41 millones de hectáreas entre 2015 y 2025

-

Actualidad2 días ago

Actualidad2 días agola ciencia tiene un nuevo número mágico (y una regla de oro sobre cómo darlos)