Escrito en ENTRETENIMIENTO el

Actualidad

acaba de llevarse a un destacado investigador de OpenAI, según Bloomberg

¿Cuáles son los ingredientes para ganar la carrera de la inteligencia artificial o, al menos, para asegurarse un lugar en la élite? No existe una receta mágica, pero hay tres elementos clave: liderazgo, talento e inversión. Todas están íntimamente relacionadas, y las compañías que compiten en este terreno no escatiman recursos para asegurarlos.

No es casual que Google y Meta hayan ofrecido condiciones millonarias para reforzar sus equipos de inteligencia artificial. Ese contexto ha provocado la salida de perfiles destacados de OpenAI, que han encontrado acomodo en la competencia. Pero a las amenazas que representan los gigantes tecnológicos estadounidenses se suma ahora un nuevo actor: Tencent.

Un salto de OpenAI a Tencent que no pasa desapercibido

Bloomberg asegura que el conglomerado chino ha fichado al reputado investigador Shunyu Yao, en lo que describe como “una de las deserciones más notorias del sector de la IA de Estados Unidos a China”. La información procede de fuentes cercanas al caso que hablaron con el medio bajo condición de anonimato.

Al revisar el perfil de LinkedIn de Yao, se observa que trabajó casi cinco años en la Universidad de Princeton antes de incorporarse como Research Intern a OpenAI en febrero de 2024. Cuatro meses más tarde fue ascendido a Research Scientist, cargo que sigue figurando como su último puesto.

Una de las fuentes citadas por Bloomberg señala que Tencent ofreció a Yao una compensación que podría alcanzar los 100 millones de yuanes (unos 11,9 millones de euros), aunque no se han especificado las condiciones necesarias para llegar a esa cifra. El medio también destaca que Yao es graduado de la Universidad de Tsinghua, considerada la institución de referencia en ciencia e ingeniería en China, y que más tarde completó un doctorado en Estados Unidos.

Un informe de la Fundación de Tecnologías de la Información e Innovación refleja cómo ha cambiado el panorama en apenas unos años: en 2019, el 35% de los investigadores de IA de mayor nivel (el 2% superior a nivel mundial) eran originarios de Estados Unidos, frente a un 10% de China. Sin embargo, en solo tres años, la cuota estadounidense cayó un 7%, mientras que la de China creció un 16%.

Si los rumores se confirman, no estaríamos ante un talento formado en Estados Unidos que emigra a China, sino ante un investigador chino que, tras adquirir experiencia de primer nivel en el país norteamericano, regresa a su país con ese bagaje. China busca competir de tú a tú con Estados Unidos por el liderazgo en inteligencia artificial.

Tencent no es un actor cualquiera: es uno de los mayores grupos tecnológicos del mundo, propietario de WeChat —la aplicación de mensajería más usada de China— y de la red social QQ. Además, es un gigante en videojuegos, tanto como desarrollador y editor como inversor en estudios globales. Según las fuentes, su objetivo al fichar a Yao es reforzar la integración de IA en sus productos y servicios.

Queda por ver si este movimiento es un caso aislado o el inicio de una tendencia. Lo que está claro es que la carrera por el desarrollo de la IA ya no es solo una cuestión de innovación tecnológica: también se libra una guerra por atraer al mejor talento. Y las compañías chinas no tienen intención de quedarse atrás.

Imágenes | Donald Wu |

En Xataka | Alibaba acaba de demostrar que OpenAI se gasta 78 millones en hacer lo mismo que ellos por 500.000 dólares

ues de anuncios individuales.

Source link

Actualidad

este año se invertirá más en centros de datos que en lo que gastó EEUU para llegar a la Luna

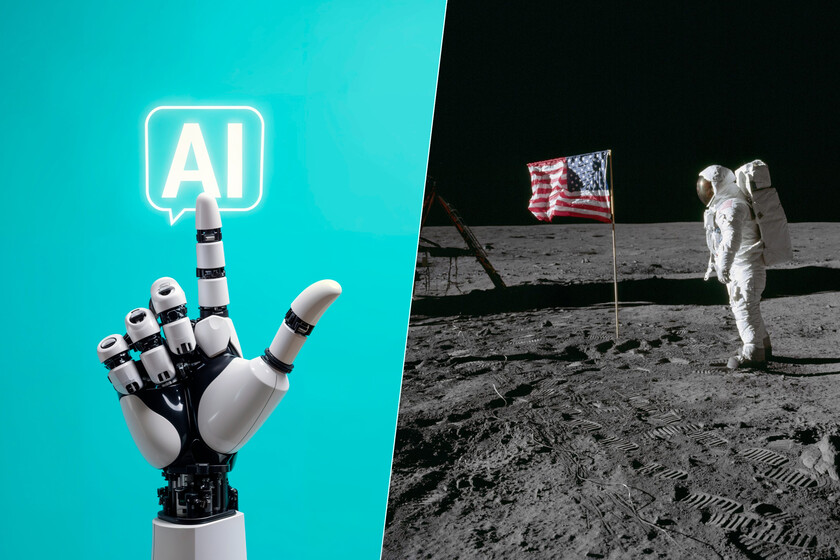

Estamos asistiendo en directo a una carrera tecnológica que ya no se mide solo en anuncios o demostraciones, sino en inversiones tangibles que crecen a una velocidad difícil de ignorar. En Estados Unidos, y también en otras regiones, las grandes compañías están destinando cantidades cada vez mayores de dinero a construir y ampliar la infraestructura que sostiene el despliegue actual de servicios de inteligencia artificial y la ampliación de capacidad de cómputo que persiguen estas empresas. Algunos hablan de entusiasmo excesivo e incluso de una posible burbuja, pero el dinero ya invertido forma parte de la realidad económica del sector, mientras que las cifras proyectadas apuntan a una escala aún mayor. La pregunta, por tanto, no es si la apuesta existe, sino qué tamaño tiene realmente.

Los números. Si el primer paso es asumir que la inversión existe, el segundo es cuantificarla con precisión. Datos recopilados por The Wall Street Journal apuntan a que Meta, Amazon, Microsoft y Alphabet (Google) podrían concentrar en 2026 un gasto conjunto de hasta 670.000 millones de dólares orientado a infraestructura de inteligencia artificial. Hablamos de desembolsos de capital asociados a centros de datos, hardware y expansión de capacidad, no solo de “ladrillo”. Cuando una sola anualidad alcanza ese orden de magnitud, la conversación deja de girar en torno a expectativas y pasa a centrarse en consecuencias económicas medibles.

No se comparan dólares. Lo que plantea el análisis no es una equivalencia directa entre cantidades gastadas en épocas distintas, sino una forma de medir el peso económico de cada esfuerzo en su propio contexto histórico. En lugar de ajustar cifras antiguas a precios actuales teniendo en cuenta la inflación, el artículo utiliza el porcentaje del producto interior bruto (PIB) como referencia común para proyectos separados a lo largo del tiempo. Ese cambio de enfoque desplaza la conversación desde el dinero absoluto hacia la magnitud relativa dentro de la economía estadounidense. Y es precisamente ahí donde la inversión asociada a la inteligencia artificial adquiere una dimensión histórica difícil de ignorar.

Las inversiones. Entre los grandes hitos económicos que suelen utilizarse como referencia histórica en Estados Unidos aparecen episodios tan distintos como la Compra de Luisiana, la expansión ferroviaria del siglo XIX o la construcción del sistema de autopistas interestatales, todos ellos con pesos relativos diferentes dentro de la economía de su tiempo. Con esa misma métrica, ese esfuerzo se ha estimado en torno a las siguientes magnitudes:

- Compra de Luisiana: 3% del PIB

- Expansión ferroviaria: 2% del PIB

- Autopistas interestatales: 0,4% del PIB

- Programa Apolo: 0,2% del PIB

Como podemos ver, la inversión prevista en infraestructura de inteligencia artificial se sitúa alrededor del 2,1% del PIB frente al 0,2% del PIB del Programa Apolo.

No es lo mismo, pero. El paralelismo histórico funciona como herramienta de escala, no como equivalencia institucional. Los grandes proyectos con los que se compara el momento actual fueron, en muchos casos, iniciativas públicas financiadas directa o indirectamente por el Estado federal, mientras que la inversión en infraestructura de IA corresponde sobre todo a gasto corporativo. Esa distinción es importante, sin embargo, desde la perspectiva estrictamente económica, el tamaño relativo del esfuerzo sigue siendo comparable.

El Estado no paga la factura principal. Que el grueso de la inversión sea privada no significa que el sector público permanezca al margen. No es ningún secreto que el Gobierno de Estados Unidos influye en el ritmo y la forma del despliegue mediante decisiones regulatorias, concesión de permisos, planificación energética y uso de suelo federal para nuevas infraestructuras vinculadas a centros de datos. Este conjunto de palancas no sustituye al capital corporativo y, al mismo tiempo, encaja con una estrategia más amplia orientada a preservar el liderazgo estadounidense en la carrera global por la IA.

Comparación histórica. Esto termina señalando algo más profundo que una simple cifra: indica el tipo de prioridad que una sociedad decide otorgar a determinadas tecnologías en un momento concreto. Cuando la inversión en infraestructura de IA alcanza un peso relativo comparable al de los grandes hitos económicos estadounidenses, la lectura trasciende el sector tecnológico y entra en el terreno estratégico.

En Xataka | Daniela Amodei, cofundadora de Anthropic: “estudiar humanidades será más importante que nunca”

ues de anuncios individuales.

Source link

Actualidad

“The dominATE Experience”: la cinta de Stray Kids recauda 18.8 mdd en su primer fin de semana

EFE.- La película documental “Stray Kids: The dominATE Experience“, que recoge el detrás de escena de la última gira del grupo de K-pop Stray Kids, recaudó en su primer fin de semana 18.8 millones de dólares en todo el mundo.

La película, estrenada en cines de todo el mundo, ocupa el cuarto puesto entre las más taquilleras de Norteamérica —Estados Unidos y Canadá—, donde ha recaudado 5.5 millones de dólares.

Este triunfo ocurre en el marco de la intensificación en la popularidad que han tenido los distintos grupos de K-pop a nivel mundial, cabe recordar que este grupo también agotó todas sus entradas en poco tiempo para las fechas en las que ofreció uno de sus conciertos de la misma gira en México.

El primer puesto en ese mercado es para “¡Ayuda!“, de Sam Raimi, que ha recaudado este fin de semana en la región un total de 10 millones de dólares y acumula 53.7 millones desde su estreno hace dos semanas en todo el mundo.

”Solo Mio” ha reunido 7.2 millones de dólares en taquilla, seguido de ”Iron Lung” con seis, y ocupan la segunda y tercera posición respectivamente en la región.

Otro de los estrenos de este fin de semana en Norteamérica, ”Dracula: A Love Tale” dirigida por Luc Besson, se posiciona en quinto puesto en la taquilla con 4.5 millones de dólares de recaudación. Si se suma el mercado internacional, su recaudación asciende a un total de 33.6 millones para esta película europea estrenada en 2025.

Mientras tanto, “Melania“, el documental sobre la primera dama de Estados Unidos, se desplomó al puesto número nueve con 2.37 millones de dólares, lo que representa una caída del 67% en las ventas de entradas.

En el ámbito internacional. y animado, ”Zootopia 2”, se mantiene en el puesto número uno en China, donde ha arrasado desde su estreno y acumula una recaudación mundial de mil 800 millones de dólares.

ues de anuncios individuales.

Source link

Actualidad

Con el segmento de consumo ahogándose, Samsung es la primera en fabricar memoria HBM4. Y será para NVIDIA, claro

Samsung es uno de los nombres propios de este febrero. Se espera que presenten los Galaxy S26, pero tienen bajo la mesa algo que será un revulsivo no sólo para sus arcas, sino para el motor de la economía de Corea del Sur. Nos referimos a las memorias de alto ancho de banda porque, en plena crisis de la RAM y los SSD, Samsung está preparada para fabricar en masa las memorias HBM4.

Y será para la IA, cómo no podía ser de otra forma.

En corto. La compañía surcoreana no lo ha confirmado, pero informes recientes publicados por Reuters y fuentes locales como el Korea JoongAng Daily apuntan que Samsung comenzará a fabricar en masa los chips de memoria HBM4 a partir de la próxima semana.

Será la primera de las tres empresas que dominan la producción de chips de memoria (las otras son la surcoreana SK Hynix y la estadounidense Micron, la que se ha ido de la RAM de consumo) en empezar a fabricar en grandes cantidades estas memorias fundamentales para la inteligencia artificial.

HBM4. Este tipo de memoria, como su nombre indica, cuenta con un enorme ancho de banda. Esto es crucial para las necesidades de la GPU y, aunque NVIDIA se ha mantenido fiel a la memoria GDDR para sus tarjetas gráficas, AMD sí coqueteó con la tecnología apilada de los chips HBM para sus GPU Vega. Sin embargo, no es una tecnología para consumo no porque sus prestaciones no sean adecuadas, sino porque es demasiado caro.

Hacer memoria HBM es más costoso que fabricar chips DRAM tradicionales, pero las ventajas están ahí. Con HBM4, por ejemplo, la densidad de los chips apilados permite el doble de ancho de banda que en la generación anterior. Esto es clave para transmitir más datos por segundo, pero además consumen hasta un 40% menos de energía que las memorias HBM3.

NVIDIA. La máxima interesada es, como hemos contado en anteriores ocasiones, NVIDIA. Y si NVIDIA es beneficiada, prácticamente toda la industria puntera de la inteligencia artificial se aprovechará de ello debido a que sus chips son los que están moviendo la industria actualmente. Se estima que las memorias de Samsung irán a parar a los sistemas de aceleración Vera Rubin de NVIDIA

De hecho, se ha reportado que el propio Jensen Huang ha instado a acelerar y aumentar la producción de estos chips. Bueno, Huang ha pedido a toda la industria de semiconductores que manufacturan componentes de sus tarjetas que se pongan las pilas, no es algo que ataña sólo a Samsung.

Punta de lanza. Según una fuente del Korea KoongAng Daily, “Samsung es la que tiene la mayor capacidad de producción del mundo y la línea de productos más amplia. Ha demostrado una recuperación en su competitividad tecnológica al convertirse en la primera en producir en masa la memoria HBM4 de mayor rendimiento”.

Porque, en este campo, se espera que su máxima competidora, la vecina SK Hynix, empiece a fabricar en masa su respuesta entre marzo o abril, tiempo de ventaja suficiente para que Samsung empiece a enviar su memoria a NVIDIA. Y, aquí, la gran ventaja de Samsung es que no depende de TSMC: tiene su propia fundición y los módulos HBM4 están basados en una fotolitografía de 4 nanómetros.

Mirando al futuro. El retraso de SK Hynix no es porque se hayan dormido en los laureles: son los que llevan la batuta en la anterior generación gracias a la memoria HBM3E, pero debido a su cronograma y a que no lo necesitaban, empezaron a desarrollar la nueva generación más tarde que Samsung. Pero claro, aunque HBM sea el estándar en sistemas de IA actuales, ya hemos dicho que son chips caros y, además, se calientan una barbaridad, necesitando equipos de disipación a la altura.

Y ahí es donde las empresas están combinando la producción de memoria HBM4 con una nueva generación de memoria DRAM. La idea es encontrar una manera de que esta memoria -más lenta, pero barata y ‘fresca’- pueda competir en ancho de banda con la HBM. Samsung y SK Hynix están en ello, pero tendrán que competir contra alguien que no jugaba en esta liga: una Intel que no llega sola, sino de la mano del gigante japonés SoftBank.

En definitiva: Samsung se ha propuesto volver por sus fueros en lo que a músculo manufacturero se refiere. Y lo más importante de todo es que todas las empresas que hacen módulos de memoria siguen centradas en una cosa: hace hardware para la inteligencia artificial mientras componentes como la RAM y SSD de consumo tienen los precios por la estratosfera.

Imágenes | Maxence Pira, Choi Kwang-mo, logo de NVIDIA (editada)

ues de anuncios individuales.

Source link

-

Actualidad1 día ago

Actualidad1 día agoMiles de personas se cambian de ropa nada más del trabajo. La neurociencia tiene algo que decir: llevan razón

-

Actualidad1 día ago

Actualidad1 día agola Grokipedia de Elon Musk

-

Actualidad1 día ago

Actualidad1 día agola Grokipedia de Elon Musk

-

Deportes2 días ago

Deportes2 días agoEl FC Barcelona se desvinculó oficialmente de la Superliga

-

Deportes2 días ago

El FC Barcelona se desvinculó oficialmente de la Superliga

-

Actualidad1 día ago

Actualidad1 día agohoy sigue dominando Sri Lanka

-

Actualidad1 día ago

Actualidad1 día agodesafiar las leyes de la gravedad

-

Actualidad2 días ago

Actualidad2 días agoCrear un compilador de C costaba 2 millones de dólares y tardaba 2 años. Claude Opus 4.6 lo ha hecho en dos semanas por 20.000 dólares