Escrito en ENTRETENIMIENTO el

Actualidad

la RAM apunta a encarecerse todavía más

Durante años hemos aceptado que los móviles fueran subiendo de precio a cambio de mejores cámaras, mejores pantallas, procesadores más rápidos y diseños, por decirlo de alguna manera, cada vez más refinados. También hemos empezado a asumir que la IA integrada en el dispositivo no llega gratis: suele exigir más potencia, más almacenamiento y más memoria. La sorpresa es que uno de los próximos golpes puede venir precisamente de ahí, de la RAM móvil, un componente que suele pasar desapercibido, pero pero muy presente en el coste real de cada smartphone que llega al mercado.

La señal más clara llega desde la LPDDR5X, una de las memorias móviles más relevantes del mercado actual y que ya venía de un movimiento poco habitual. Según los datos de TrendForce, este tipo de memoria registró en el primer trimestre de 2026 una subida intertrimestral de entre el 58% y el 63%. Se trata del mayor incremento trimestral de su historia. Lo llamativo es que ese salto no parece haber cerrado el ciclo: la previsión para el segundo trimestre apunta a una escalada todavía más intensa.

Si nos enfocamos en la previsión para el segundo trimestre, cambia la escala del problema. Una proyección atribuida a TrendForce, compartida Jukan Choi, apunta a que los precios de contrato de la DRAM móvil crecerán entre un 93% y un 98% en términos intertrimestrales durante ese periodo. Dicho de otra forma: no hablamos de una subida más dentro de un mercado tensionado, sino de un salto cercano a duplicar el precio en apenas tres meses. Para la industria del smartphone, una cifra así no es ruido de fondo.

Cabe señalar que TrendForce trabaja con informes de pago dirigidos principalmente a inversores institucionales, analistas y compañías del sector, así que el documento completo no está disponible abiertamente. La parte relevante para este artículo ha trascendido a través de Choi, analista de semiconductores en Citrini Research. El experto acumula más de 100.000 seguidores en X y sus comentarios han sido citados por medios como The Economist, que los incluyó en un artículo sobre el impacto de la IA en la electrónica de consumo.

El impacto en el precio de la RAM en los teléfonos móviles

Aquí no estamos hablando del precio que ve un usuario cuando busca memoria en una tienda. La DRAM móvil se negocia en otro terreno: el de los contratos entre fabricantes de memoria, como Samsung, SK Hynix o Micron, y grandes clientes que compran enormes volúmenes para integrar esos chips en sus productos. Este mundo lo integran marcas de móviles, fabricantes de servidores y otros OEM. Por eso el dato importa: no describe una compra puntual, sino el coste base con el que la industria empieza a fabricar sus próximos dispositivos.

La subida tampoco aparece de la nada. SemiAnalysis apuntó a comienzos de abril de 2026 que los precios de la DRAM podrían más que duplicarse durante este año y volver a registrar otro incremento de doble dígito en 2027. La misma firma señalaba que el precio de contrato de la LPDDR5 había subido más de 3 veces desde el primer trimestre de 2025, y que probablemente superaba los 10 dólares/GB en el mercado abierto durante el primer trimestre de 2026. Es decir, el segundo trimestre no inaugura la tensión: la acelera.

Los precios de la DRAM podrían más que duplicarse durante este año y volver a registrar otro incremento de doble dígito en 2027.

El telón de fondo es la IA. La memoria HBM, clave para alimentar las GPU que sostienen muchos centros de datos de inteligencia artificial, sigue en una situación de escasez estructural y absorbe buena parte de la inversión del sector. La consecuencia es sencilla de entender: si buena parte del dinero, la capacidad productiva y la atención de los fabricantes se dirige a esa memoria de alto ancho de banda, queda menos margen para aliviar la tensión en otras familias de DRAM. Entre ellas está la memoria móvil, que ahora compite en una cadena de suministro mucho más exigida.

A eso se suma otro detalle importante: la memoria de clase smartphone ya no vive solo dentro del smartphone. NVIDIA utiliza LPDDR5X en sus procesadores Grace y Vera, diseñados para sistemas de servidor vinculados a IA. La lectura para el mercado móvil es clara: una tecnología utilizada en teléfonos y dispositivos compactos también forma parte de arquitecturas que compiten por recursos en el centro de la carrera por la inteligencia artificial.

La diferencia con el mundo del PC ayuda a entenderlo mejor. Si montamos un ordenador, podemos elegir cuánta RAM comprar, buscar una oferta e instalar el módulo nosotros mismos. Con los móviles no funciona así: compramos un dispositivo completo, con la memoria ya integrada y sin margen real para intervenir después. Eso hace que la subida de la LPDDR no se vea de forma directa, pero no significa que desaparezca. Queda incorporada al coste de fabricar el teléfono y, desde ahí, puede terminar influyendo en el precio que pagamos.

Counterpoint ayuda a convertir ese encarecimiento en una cifra mucho más fácil de visualizar. Para una configuración de gama alta, con 16 GB de LPDDR5X HKMG y 512 GB de almacenamiento UFS 4.1, la firma proyectaba un aumento del BOM de entre 100 y 150 dólares para el segundo trimestre de 2026. Hablamos del coste de materiales, no del precio de venta, así que no conviene trasladar esa cifra de forma mecánica al consumidor. Aun así, es una señal que no pasa desapercibida.

La mala noticia, por tanto, no es que todos los móviles vayan a subir de precio de forma automática ni en la misma proporción. Eso dependerá de cada fabricante, de sus contratos, de sus márgenes y de cómo configure cada gama. Pero el factor está ahí: si la memoria móvil se encarece con esta fuerza, el coste de fabricar un smartphone cambia inevitablemente. Y en un mercado que ya venía acostumbrándonos a precios cada vez más exigentes, la RAM se perfila como otro obstáculo para quienes esperaban una bajada de precios a corto plazo.

En Xataka | Apple había sido capaz de mantener precios pese a la loquísima subida de la memoria RAM. Eso se ha terminado

ues de anuncios individuales.

Source link

Actualidad

Cada vez buscamos más respuestas humanas en Reddit. Esa es la razón de que ahora el buscador de Google sea un Reddit disfrazado

Google ha actualizado su plataforma de búsquedas por enésima vez, pero lo ha hecho con un cambio especialmente significativo. La experiencia de usuario en sus buscadores con IA (tanto AI Overviews como AI Mode) intenta volverse más “humana”. Y para ello en esas búsquedas Google añadirá más contexto a los enlaces, como extractos de foros y blogs de internet. Y si hay un beneficiado (o perjudicado) de ese movimiento, ese es Reddit.

Google ya era una pasarela a Reddit. Hay un comportamiento que Google lleva años viendo en sus datos y que durante mucho tiempo prefirió no reconocer públicamente: cuando alguien quiere una respuesta real a una pregunta real, añade “Reddit” al final de la búsqueda. No porque Reddit sea una fuente necesariamente fiable, sino porque en Reddit se reúnen personas reales que han vivido esa cuestión, la han intentado resolver y han escrito sobre ello sin que nadie les pagara por hacerlo. Google, con toda su infraestructura y todos sus algoritmos, no había conseguido replicar eso. Así que en lugar de intentarlo va a incorporar esas respuestas directamente.

Qué ha cambiado exactamente. La actualización del buscador hará que en los AI Overviews aparezcan fragmentos de foros, redes sociales y otras “fuentes de primera persona”. Cuando alguien busque algo para lo que no existe una respuesta objetiva única, la IA de Google incluirá perspectivas y opiniones qu encuentre en todo tipo de fuentes (supuestamente) humanas online. Al hacerlo añadirá el nombre del creador de ese contenido (o su avatar) y el origen del que procede dicha perspectiva. Google también promete añadir más contexto sobre el origen de sus respuestas generadas por IA, de forma similar a cómo ChatGPT o Claude incluyen enlaces que respaldan sus respuestas.

Cansados de tanto SEO. La razón es obvia: los resultados orgánicos de Google para preguntas prácticas y subjetivas —”qué aspiradora me compro”, “cómo le curo el oído a mi perro”, “cuál es el mejor barrio para vivir en Valencia”— están dominadas por el SEO y esas técnicas optimizadas para aparecer en Google. Importa posicionar, no responder bien la pregunta. Precisamente ahí es donde Reddit, como otros foros o blogs personales tienen algo que ese contenido no suele tener: la experiencia real de alguien que estuvo en la misma situación. Google lo resume en su propio comunicado sin rodeos: “Para muchas búsquedas, la gente busca cada vez más el consejo de otras personas”.

La contradicción que Google no ha resuelto. Hay un potencial problema en esta nueva forma de concebir esas búsquedas con IA. Los AI Overviews fueron diseñados para responder preguntas directamente y así ahorrarle al usuario el trabajo de ir haciendo clic, leyendo e investigando. Ahora van a incluir perspectivas diversas e incluso contradictorias de foros y redes sociales. Así pues, ¿responderá AI Overviews la pregunta, o hará que volvamos a acudir a las fuentes para que encontremos la respuesta?. Si es lo segundo, no será muy diferente de lo que ya hacía el buscador tradicional de Google. Hay aquí un interesante desequilibrio entre “te damos la respuesta” y “te damos contexto para que encuentres la respuesta”. En cierto sentido, la decisión de Google complica las búsquedas.

Los modelos de IA son cada vez menos propensos al fallo. Los célebres casos de añadirle pegamento a la pizza son mucho menos frecuentes ahora, y a menudo los nuevos modelos presumen de una reducción significativa en las tasas de “alucinaciones” que tienen. GPT-5.5 Instant, lanzado esta semana “produjo un 52.5% menos de alucinaciones que GPT‑5.3 Instant”, indicaba OpenAI en su anuncio oficial. El problema es que esas alucinaciones son cada vez más difíciles de detectar porque estos chatbots esconden muy bien esas meteduras de pata. Que ahora el sistema incluya contenido sin verificar o validar de redes como Reddit puede ser problemático: los votos de la comunidad no siempre miden lo veraz o útil que resulta cierto hilo.

Usar Reddit tiene su aquel. Esta plataforma tiene valor precisamente porque no está optimizado para los algoritmos de Google: es caótica y contradictoria. A veces hay respuestas brillantes de la gente, pero otras hay comentarios totalmente erróneos. Cuando un usuario añade “Reddit” a su búsqueda y lee los resultados, está sopesando automáticamente qué comentarios son útiles y cuáles no. Pero ese paso desaparece si Google extrae fragmentos de esas discusiones para incluirlos en un AI Overview. Elimina ese paso de filtrado humano y presenta esas respuestas con una autoridad que quizás no deberían tener. Google tendrá muchas más dificultades que un humano de distinguir el comentario de alguien que lleva veinte años trabajando en fontanería del de alguien que hace chapuzas por afición.

El contrato en la sombra. Esta no es solo una decisión editorial o tecnológica. En 2024 Google firmó un acuerdo de 60 millones de dólares al año con Reddit para acceder a sus datos y entrenar sus modelos. No está incorporando contenido de esta red social como un servicio público: lo que está haciendo es monetizar un contrato comercial. Su mensaje de que está destacando esas “voces originales”, lo que en realidad está diciendo es que ha pagado por ese acceso privilegiado al contenido de Reddit y ahora va a aprovechar dicho acceso y a rentabilizarlo. Esos ingresos son interesantes para Reddit, sin duda, pero hay un problema: los clics.

El precedente de Stack Overflow. No hace falta especular mucho sobre lo que puede pasar porque ya ha pasado. Stack Overflow es la mayor comunidad de preguntas y respuestas técnicas de internet, pero ha perdido la mayor parte de su tráfico en dos años porque las empresas de IA empezaron a recolectar todas esas respuestas para entrenar sus modelos y luego servirlas a sus usuarios directamente. Eso provocó que los usuarios dejaran de visitar Stack Overflow y que los expertos dejaran de contestar preguntas. La calidad de los nuevos contenidos en esta red se vio claramente afectada, y quedó claor que si la IA ya te daba la respuesta sin tener que entrar en Stack Overflow, ¿para qué entrar? El peligro para Reddit es exactamente el mismo.

Google no tenía muchas alternativas. ChatGPT, Claude y Perplexity llevan tiempo capturando cuota de mercado en esas búsquedas donde la gente antes añadía “Reddit”: preguntas prácticas, recomendaciones subjetivas, o resolución de problemas específicos. Estos modelos contestan de forma directa y natural y evitan tener que navegar por resultados llenos de SEO. Incluir ese contexto y enlaces de Reddit es un intento de usar esa ventaja para ofrecer algo que los modelos de lenguaje rivales no pueden (de momento): perspectivas humanas actualizadas y verificadas por comunidades reales. La ironía es que la IA que parece saberlo todo solo aprende y mejora gracias al conocimiento y a la experiencia humana acumulada y compartida.

¿Quién paga por todo esto? Al final estamos viendo cómo Google está usando un sistema híbrido, pero la pregunta importante no es si funcionará bien o mal. La pregunta es quién paga para que la web que alimenta ese híbrido siga existiendo. Google extrae contenido de Reddit, blogs, foros y redes sociales, lo procesa con IA y lo sirve en un resumen que elimina la necesidad de visitar las fuentes originales. Y ahí entra el inevitable y peligroso círculo vicioso. Si esos sitios pierden tráfico, pierden ingresos. Si pierden ingresos, pierden la capacidad de generar el contenido que Google necesita para que sus AI Overviews funcionen. Todo un dilema aun sin solucionar.

En Xataka | Los foros de internet están desapareciendo porque ahora todo es Reddit y Discord. Y eso es preocupante

ues de anuncios individuales.

Source link

Actualidad

Si la pregunta es cuánto tiempo tenemos que usar la IA para volvernos perezosos, la respuesta es: un suspiro

Diez minutos. Es el tiempo que tarda la IA en tener un efecto negativo en nuestra habilidad para razonar y resolver problemas, o al menos eso es lo que han concluido en un nuevo estudio en el que han medido cómo el uso de asistentes de IA no solo mejora el rendimiento inmediato, sino que reduce la persistencia y empeora el desempeño cuando no tenemos acceso a la IA.

El estudio. Investigadores de Carnegie Mellon, MIT, UCLA y Oxford han publicado un experimento controlado y aleatorizado que mide el impacto del uso de IA en la capacidad de resolver problemas de forma independiente. En total participaron más de 1.200 personas en tres experimentos distintos. La conclusión de los investigadores va en la dirección de lo que hemos visto en otros estudios anteriores: usar IA potencia nuestra productividad, pero tiene un coste cognitivo.

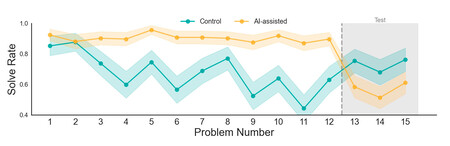

El experimento. Se realizó un primer experimento con 354 participantes en el que debían resolver doce fracciones simples. Algunos de los participantes tenían un panel lateral con un asistente IA (GPT 5) que podían usar para resolver las operaciones. Lo curioso vino cuando se les retiró el acceso al chatbot y tuvieron que responder tres preguntas más sin la ayuda de la IA. El resultado fue que las personas que habían usado IA fallaron más en sus respuestas que el grupo de control.

Confirmando resultados. Los investigadores hicieron un segundo experimento en el que duplicaron los participantes (667) e hicieron un pretest para medir el nivel. Además, añadieron un panel lateral “placebo” (sin IA) a los participantes del grupo control, para que no hubiera diferencias de interfaz. Los resultados volvieron a mostrar que las personas que usaban IA fallaban más que el grupo control.

Hubo un tercer experimento en el que se hicieron problemas de comprensión lectora con 201 participantes y volvió a pasar lo mismo: al quitar la IA, ese grupo es el que peor rindió.

El matiz clave. Hay un detalle importante del estudio y es que midieron cómo los participantes usaban la IA. El 61% la usó para que les diera las respuestas directamente, mientras que otros la usaron para que les diera pistas o les hiciera aclaraciones. Los resultados de este segundo grupo fueron más similares a las del grupo de control. En cambio, quien pedía las soluciones tal cual a la IA fallaron mucho más cuanto esta fue retirada. Esto sugiere lo que hemos dicho anteriormente: el efecto negativo de la IA en nuestra cognición depende en gran parte de cómo la usemos. No es lo mismo copiar respuestas sin cuestionar, que usarla como apoyo en el proceso cognitivo.

La nueva caja tonta. El miedo a que la tecnología nos vuelva tontos no es algo que haya surgido con la IA, pasó con la calculadora, ha pasado con la televisión, con los videojuegos y está pasando con los móviles. Aunque hay estudios que apuntan en esa dirección, no hay una evidencia clara de que la tecnología dañe nuestra cognición. Sin embargo, también es cierto que hasta ahora no habíamos tenido acceso a una tecnología en la que pudiéramos delegar todo nuestro pensamiento.

Imagen de portada | Xataka

ues de anuncios individuales.

Source link

Actualidad

BTS conquista la CDMX: miles de fanáticos asisten al primer concierto de la banda surcoreana

Alrededor de 65 mil personas fanáticas de la banda surcoreana BTS disfrutaron la noche de este jueves la primera fecha en la Ciudad de México de su gira mundial “Arirang”.

La llegada de las Armys (como se hacen llamar los seguidores de la banda) al recinto ubicado en la alcaldía Iztacalco empezó al menos seis horas antes del evento que inició aproximadamente a las 8:00 de la noche de este jueves, en el Estadio GNP.

Asimismo, muchas personas, que calificaron el ver a la banda como un sueño, fueron a las inmediaciones del recinto sin tener boleto debido a la demanda excesiva y los altos precios de las entradas en reventa que hasta alcanzaban los 40 mil pesos.

Ante eso, las autoridades capitalinas detuvieron a 14 personas —nueve adultos y cinco menores de edad— señaladas de revender boletos.

“Ha sido muy triste y más para una Army (fandom de BTS) de verdad (…) Es muy triste ver a varias armys que están buscando boleto, con carteles buscando boleto o de aficionada a aficionada, que se les rompa la ilusión”, explica en entrevista con EFE Sofía, una joven de 18 años que tampoco podrá ver a BTS en ninguna de las tres fechas en las que actuarán en Ciudad de México.

Aunque la falta de boletos para ver a BTS se convirtiera en un tema de política nacional y la presidenta mexicana, Claudia Sheinbaum, extendiera una carta al mandatario coreano, Lee Jae-myung, para ampliar las fechas de los conciertos en la capital, muchos no aficionados lograron conseguir boletos en las engorrosas filas virtuales.

A la vista de la gran cantidad de demanda que se podría prever para los conciertos de BTS, la reventa ha sido aún mayor que en otros eventos musicales masivos, a pesar de que desde hace meses las aficionadas del grupo se manifestaron pidiendo “un límite para los revendedores”, aunque sea para una gira futura.

“Sí, (la reventa) ha sido mayor y los están dando demasiado caros. Un boleto en 40 mil pesos es algo que no costaba un boleto originalmente en platino o VIP y es algo que se me hace muy feo de los revendedores. He visto a muchas chavas estafadas”, añade la joven.

Esta mañana, la presidenta Sheinbaum confirmó que BTS volverá a México en 2027, una noticia que reveló un día después de su reunión con el grupo en el Palacio Nacional y tras un evento con los aficionados que congregó, según la mandataria, a más de 50 mil personas en el Zócalo capitalino.

Según la Cámara Nacional de Comercio, Servicios y Turismo de la Ciudad de México (Canaco CDMX), los conciertos programados para los días 7, 9 y 10 de mayo generarán una derrama económica estimada en mil 861 millones de pesos.

Una meta cumplida

Durante su jornada laboral o gracias a la obsesión de un familiar o amigo, 65 mil aficionados pudieron comprar una entrada para la primera de las tres fechas en las que BTS actuará en Ciudad de México, un momento que millones de aficionados mexicanos estaban esperando desde que en 2017 la banda visitó el país por última vez”.

“Para mí es un sueño (…) son una parte muy importante para mí. Me impulsan a seguir con mis metas y mis sueños, con mi vida. Sus canciones me alientan y la verdad, desde bien chiquita ya los quería ver. Es mi sueño desde los 14 años que los sigo y ahora es una meta para mí”, explica Dehbani sin contener varios gritos de emoción a sus 23 años.

Tras viajes de autobús de más de 16 horas desde ciudades norteñas como Monterrey u otros estados del país, los aficionados comenzaron a llegar al recinto y algunos ya esperaban desde las cinco de la mañana haciendo fila para poder ver lo más cerca posible a sus ídolos.

Angélica, una Army norteña, tiene 44 años, según marca su credencial para votar, pero para ella los más relevantes son los 11 que lleva siendo Army y el apoyo que sintió de ellos “en un momento muy crítico de su vida”.

Con información de EFE.

ues de anuncios individuales.

Source link

-

Musica2 días ago

Musica2 días agoMiércoles 2×1 en Superboletos: Lista de conciertos en Guadalajara que aplican HOY 6 de mayo

-

Deportes1 día ago

Deportes1 día agoCiclismo | Destrozan una estatua de Eddy Merckx en Bruselas

-

Deportes2 días ago

Deportes2 días agoMundial 2026 | Aeropuerto de la CDMX luce menos preparado para la Copa del Mundo: Expertos

-

Deportes1 día ago

Deportes1 día agoMundial 2026: Una Copa del Mundo con 48 selecciones aumentará competitividad y atraerá inversión: Infantino

-

Deportes1 día ago

Deportes1 día agoChivas recula y permitirá asistencia de sus jugadores al Tricolor en tiempo y forma

-

Deportes1 día ago

Deportes1 día agoMundial 2026: Jugador que no reporte hoy con la Selección no va a la Copa del Mundo: Javier Aguirre | Video

-

Deportes22 horas ago

Deportes22 horas agoMundial 2026: Irán exige garantías de la FIFA para asistir a Estados Unidos

-

Deportes1 día ago

Deportes1 día agoMundial 2026: Toluca liberará a sus seleccionados nacionales, pero aclara que actúo conforme al acuerdo y reglamento