Actualidad

el motivo son las leyes de la física

Seguro que ya sabes (la publicidad online te lo está recordando día sí, día también) que con un sencillo prompt puedes generar un videojuego. La IA te lo hace, pero lo que no puede hacer es jugarlo. La razón no es que los juegos sean difíciles en abstracto: es que el mundo real obedece a las mismas leyes físicas en todas partes, y los videojuegos no.

Hacer, no jugar. La paradoja es llamativa: con herramientas como Cursor o Claude, un prompt genera un clon de un juego clásico funcional. ‘Asteroids’, por ejemplo. Sin embargo, ese mismo sistema no superaría ni el primer nivel de su propia creación. Julian Togelius, director del Game Innovation Lab de la Universidad de Nueva York y cofundador de la empresa de testing Modl.ai, lleva meses investigando por qué, y lo ha desgranado en una entrevista.

Programar no es un juego. Togelius define la programación desde un punto de vista estructural: un juego muy bien diseñado. Cada línea de código viene con un enunciado claro, un criterio de éxito verificable y feedback de posibles fallos, y el programa indica exactamente dónde y por qué ha fallado. Los LLM (modelos de lenguaje) han sido entrenados con cantidades masivas de código y afinados mediante aprendizaje por refuerzo para resolver exactamente ese tipo de problemas. Programar es, en términos de estructura de tarea, un juego excepcionalmente “bien portado”, como lo define Togelius. Por eso hay tanta gente que encuentra divertido programar.

Sin embargo, los videojuegos son otra historia: el espacio de acción se rige por reglas más arbitrarias, el feedback puede ser inmediato o retrasarse horas en llegar, el razonamiento espacial es indispensable y el margen de error es mucho más reducido. Cuando a un modelo de IA se le pide que juegue a algo, el resultado documentado en el paper que realizó Togelius es inequívoco: “fracaso absoluto”.

Con guía, por favor. Gemini 2.5 Pro completó ‘Pokémon Azul’ en mayo de 2025, pero tardó considerablemente más que cualquier jugador humano, cometió errores repetitivos y dependió de software auxiliar para lograrlo. La revista TIME analizó por qué los mejores sistemas de IA siguen teniendo dificultades con ‘Pokémon’. Y eso que es de los pocos títulos que logran acabar. Lo consiguen porque estos sistemas cuentan con APIs específicas para consultar guías estratégicas. Que ‘Pokémon’ o ‘Minecraft’ (otro título que las IAs pueden navegar) sean dos de las franquicias más documentadas de la historia del videojuego, con millones de horas de walkthroughs disponibles en internet, es la clave de que lo consigan con mayor facilidad.

La clave está en la física. Pero… ¿por qué un modelo de lenguaje puede escribir un ensayo sobre física cuántica y a la vez fracasar tanto en ‘Halo’ como en ‘Space Invaders’? La respuesta de Togelius es que “esos dos juegos son más diferentes entre sí, en cierto sentido, que dos ensayos académicos distintos.” Visto de otra forma: los videojuegos son muy heterogéneos. Cada uno inventa sus propias reglas, su propia lógica de espacio, su propio sistema de recompensas. Las mecánicas de un juego de plataformas son absolutamente distintas a las de un ‘Tetris’. El razonamiento espacial (dónde están los objetos, cómo se mueven, cómo se relacionan) no aparece en los datos de preentrenamiento de los modelos de lenguaje porque es inabarcable de un juego a otro.

Sin embargo, observemos una tarea aparentemente más difícil que jugar a ‘Super Mario’: conducir un coche autónomo. Y eso sí lo hacen bien las IAs. La diferencia con los juegos es que el mundo real obedece a las mismas leyes físicas en cualquier parte del planeta. El asfalto se comporta igual en San Francisco que en Shanghái, los semáforos siguen los mismos principios, el vehículo siempre responde igual. Como señala Togelius, “conducir es mucho más homogéneo que el conjunto de los videojuegos.” Aprende a conducir y podrás hacerlo en cualquier punto del planeta. Aprende a jugar a ‘Doom’ y no tendrás ni idea de cómo jugar a ‘Age of Empires’.

El criterio definitivo. Por eso Togelius propone los videojuegos como criterio para determinar el éxito de una IA: hay que calibrar si un agente capaz de aprender a completar cualquier juego del top 100 de Steam en aproximadamente el mismo tiempo que un jugador humano hábil, sin acceso a documentación previa ni integración específica. A ese baremo (que no exige ganar a la primera, sino aprender al ritmo humano) no existe hoy ningún sistema que se acerque.

Cabecera | Foto de Erik Mclean en Unsplash

ues de anuncios individuales.

Source link

Actualidad

El día que una pequeña disputa por la tecla Tab acabó revelando la gran diferencia entre IBM y Microsoft

Hay compañías que han vivido tanto que su historia ya no se cuenta solo a través de grandes lanzamientos, adquisiciones o batallas comerciales. También se cuenta en los detalles pequeños, en esas escenas aparentemente menores que, vistas con el paso del tiempo, terminan explicando mejor una época que muchos comunicados oficiales. Microsoft e IBM pertenecen a esa categoría. Sus caminos se cruzaron cuando el ordenador personal todavía estaba definiendo muchas de sus reglas, y algunas de aquellas discusiones, incluso las más diminutas, dejaron al descubierto algo más profundo que una diferencia técnica.

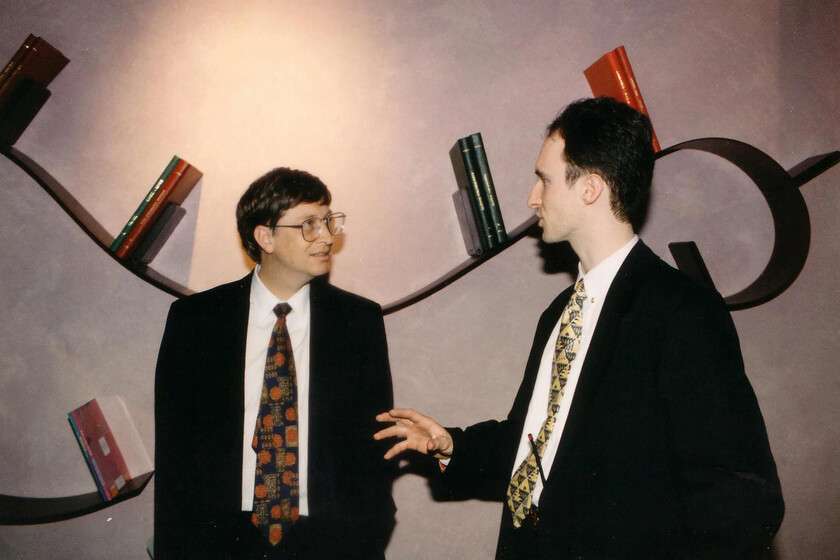

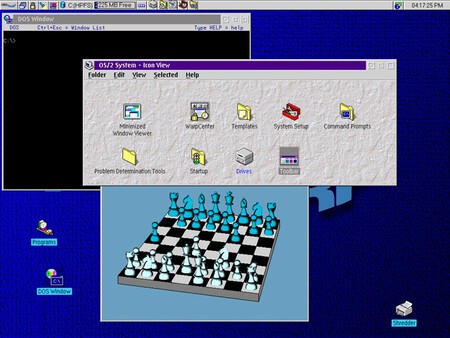

La escena la ha recuperado Raymond Chen, un veterano ingeniero de Microsoft que lleva más de tres décadas vinculado a la evolución de Windows y que desde hace años reúne en The Old New Thing algunas de las historias más curiosas del ecosistema Windows y Microsoft. Chen no presenta el episodio como una vivencia propia, sino como el recuerdo de un colega que fue destinado a las oficinas de IBM en Boca Raton, Florida, durante la colaboración entre ambas compañías en OS/2.

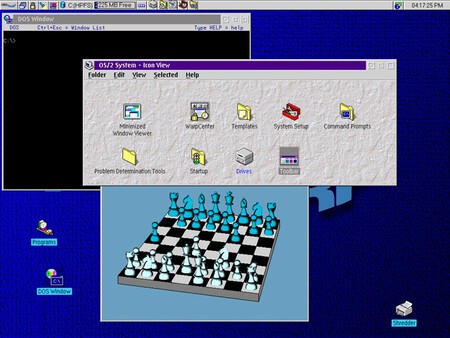

OS/2 era mucho más que otro nombre perdido en la historia del software. IBM y Microsoft lo presentaron en 1987 como un sistema operativo pensado para la línea IBM PS/2 y llamado a llevar el PC más allá de las limitaciones de DOS, con una base más moderna y ambiciones propias de una informática que empezaba a mirar más lejos. La colaboración venía de un acuerdo de desarrollo conjunto firmado en 1985, cuando el proyecto todavía no se llamaba OS/2. En ese contexto, cualquier decisión de interfaz podía tener más peso del que parece hoy, porque muchas convenciones del PC moderno todavía estaban asentándose.

Dos compañías muy parecidas y también muy distintas

El problema es que aquella colaboración reunía a dos compañías en momentos muy distintos de su vida. Microsoft era todavía una empresa joven, muy pegada al software y a una manera de trabajar más directa, mientras que IBM llegaba con décadas de historia, una estructura enorme y el peso de una cultura corporativa mucho más asentada. Chen lo resume como un choque de percepciones: desde Microsoft se veía a IBM como atrapada en una burocracia sin sentido, y desde IBM se miraba a Microsoft como unos de hackers indisciplinados. Su propio matiz es importante: probablemente había algo de razón en ambas lecturas.

La anécdota concreta empieza en Boca Raton, donde un colega de Chen trabajaba asignado a las oficinas de IBM. En algún momento surgió una discusión sobre qué tecla debía utilizarse para pasar de un campo a otro dentro de los cuadros de diálogo. El ingeniero de Microsoft tomó una decisión que hoy nos resulta casi invisible por lo asumida que está: usar Tab para esa función. A IBM no le convenció la elección y pidió que el asunto se elevara al responsable de aquel ingeniero en Redmond, una reacción que ya dejaba entrever hasta qué punto la discrepancia iba más allá de la propia tecla.

En Redmond, la petición no se entendió como un asunto que mereciera subir mucho más. El responsable del ingeniero respondió con una idea muy clara: si Microsoft había enviado a alguien a Boca Raton, era para que pudiera resolver allí decisiones como esa. Traducido a un tono más institucional, el mensaje que volvió a IBM fue que Microsoft apoyaba la elección de la tecla Tab. La reacción de IBM fue justo la contraria. En lugar de cerrar la discusión, la compañía la elevó por su propia cadena de mando hasta un vicepresidente, varios niveles por encima de quienes estaban programando.

IBM no solo había elevado la discusión, también quería una respuesta a la misma altura jerárquica. Si su vicepresidente estaba en contra de usar Tab, Microsoft debía encontrar a alguien equivalente para sostener lo contrario. El colega de Chen respondió entonces con una frase maravillosa, traducida aquí al español: “La madre de Bill Gates no está interesada en la tecla Tab”. Era una forma bastante fina de decir que aquello no merecía seguir subiendo por el ascensor corporativo. No hacía falta subir hasta las alturas de Microsoft para decidir cómo se pasaba de un campo a otro en un cuadro de diálogo.

La frase funcionó, al menos según el relato de Chen: aparentemente, después de aquella respuesta, la discusión terminó y Tab se mantuvo como la tecla elegida para avanzar entre campos. El detalle tiene gracia porque hoy casi nadie se detiene a pensar en ello: simplemente pulsamos Tab y esperamos que el cursor salte al siguiente espacio disponible. Pero hubo un momento en el que esa convención no estaba tan cerrada. Y lo que vemos en esta historia es justamente eso: una pequeña decisión de interfaz convertida en terreno de choque entre costumbre, jerarquía y criterio técnico.

La fecha exacta, sin embargo, no aparece en el relato de Chen. Sabemos que el episodio pertenece a los años de colaboración entre Microsoft e IBM alrededor de OS/2, cuyo acuerdo de desarrollo conjunto se remonta a 1985 y cuya llegada pública se produjo en 1987. Eso nos permite acotar el contexto, pero no fijar el día ni el año de la discusión por Tab.

Hay muchas decisiones detrás de los productos y servicios que usamos a diario. Algunas son enormes y visibles, pero otras pasan por debajo del radar: una tecla, un gesto, una convención de interfaz que aprendemos una vez y repetimos durante años sin preguntarnos de dónde salió. Seguramente muchas tienen una historia detrás, aunque la mayoría nunca trasciende y otras no serían especialmente interesantes. De vez en cuando, sin embargo, aparece una anécdota como esta y nos permite asomarnos a algo que casi nunca vemos: cómo se manejan las cosas dentro de las empresas que construyen la tecnología que usamos.

Imágenes | Kaatvrtg (Wikimedia Commons) |

ues de anuncios individuales.

Source link

Actualidad

El problema de comer chocolate a las 11 de la noche no son las calorías, es lo que le hace al sueño

Hay gente que sigue auténticos rituales antes de irse a dormir, como por ejemplo una buena ducha para descargar toda la tensión del día, pero también tomar un poco de chocolate negro para poder endulzarse la boca antes de dormir. Una práctica que para muchos es algo que es una aberración, pero que para saber si de verdad es una mala idea hacerlo, tenemos que recurrir a la ciencia y a los estudios que hay acerca del chocolate.

Un principio en contra. Para los detractores del chocolate nocturno, el enemigo no es el azúcar como tal, sino el propio chocolate y lo rico que es en las metilxantinas, que son alcaloides que estimulan el sistema nervioso central. Y aquí hay dos que destacan por encima de otras, como son la cafeína, que es bastante conocida, y la teobromina, que es el principal estimulante del chocolate negro.

Aquí las revisiones científicas apuntan que estas sustancias actúan bloqueando los receptores donde se une la adenosina para que actúe. Y no es para menos, porque la adenosina es la molécula que se va acumulando en nuestro cerebro a lo largo del día para generar la “presión de sueño”. Pero si las metilxantinas bloquean el punto donde se tienen que unir para actuar, el cerebro no recibe la señal de que está cansado.

Su problema. Aunque es cierto que la teobromina es más “suave” que la cafeína, su vida media en el cuerpo es prolongada. Esto significa que ese chocolate de las 11 de la noche podría estar todavía bloqueando tus ganas de dormir a las 2 de la mañana, aumentando la latencia de sueño y provocando más despertares nocturnos.

La importancia del tiempo. La ciencia ahora mismo ha dejado de mirar solo las calorías para centrarse en la crononutrición, puesto que se apunta a que el chocolate influye en los ritmos circadianos según la hora a la que se toma.

Aquí los estudios apuntan a que el chocolate puede ser un gran aliado para resincronizar el reloj biológico si se consume durante la fase activa por la mañana, pero tomarlo fuera de esta fase, cuando el cuerpo se prepara para el descanso, dificulta la sincronización de nuestros relojes periféricos. En resumen, le estamos enviando señales contradictorias al cuerpo.

No todo es negativo. En ciencia no hay únicamente extremos, sino que podemos encontrar un gran espectro de grises en medio. Esto se debe a que también hay evidencia que matiza el mensaje de que el chocolate genera insomnio, porque en modelos animales el cacao puede mejorar ciertos desajustes del sueño inducidos por estrés crónico.

Esto sugiere que, en contextos de alto estrés, los componentes antioxidantes y neuroprotectores del cacao podrían ayudar a ajustar el ritmo sueño-vigilia. No obstante, los investigadores advierten de que este beneficio se observa cuando el cacao forma parte de la dieta general, no necesariamente cuando se consume como una “bomba” de azúcar y estimulantes justo antes de apagar la luz.

No es universal. El efecto del chocolate no se da en todos de la misma manera, haciendo que cada persona pueda vivirlo de manera diferente, dependiendo de la cantidad de chocolate que se tome y también de la sensibilización. Hay que tener muy presente que cada persona metaboliza a ritmo diferente, por lo que habrá gente que pueda tomar mucho chocolate y que estas moléculas no les afecten para nada.

Imágenes | freepik

ues de anuncios individuales.

Source link

Actualidad

en Córdoba hasta hacen baterías

Las baterías de iones de litio son las que dominan el almacenamiento energético, desde móviles a vehículos eléctricos, pero tienen un gran problema: dependen de materiales que escasean, son caros y resultan conflictivos desde el punto de vista geopolítico. Así que la ciencia lleva años buscando alternativas: con elementos más abundantes y baratos como el sodio o el azufre. En ese escenario, a un equipo de investigación de la universidad de Córdoba ha dado una vuelta de tuerca a un residuo agrícola para almacenar energía: la cáscara de pistacho.

El invento. El Instituto Químico para la Energía y el Medioambiente de la UCO ha desarrollado una batería basada en azufre que no necesita litio ni metales críticos como el cobalto, el níquel o el cobre. El cátodo está hecho con cáscara de pistacho convertida en carbón microporoso que a temperatura ambiente atrapa físicamente al azufre en su interior, impidiendo que se disuelva en el electrolito y se degrade con el uso.

Esta batería sin litio alcanza una capacidad específica de aproximadamente 803 mAh·g⁻¹ a 1C y aguanta más de 1.000 ciclos completos de carga y descarga con estabilidad. En comparación con una batería de iones de litio comercial es capaz de almacenar hasta cinco veces más energía por gramo de material activo.

Por qué es importante. Porque resuelve el problema crónico de las baterías de sodio – azufre: el efecto shuttle, como concluye este paper sobre el estado de este tipo de baterías. Con el uso, parte del azufre se disuelve en el líquido interno de la batería, pasa al otro electrodo y destruye la batería. Este fenómeno provoca también reacciones secundarias con el electrolito que aceleran la degradación y reducen drásticamente la vida útil de la batería. El carbón de cáscara de pistacho lo soluciona de forma elegante: sus poros son tan pequeños que el azufre queda atrapado físicamente y no puede disolverse ni migrar, logrando estabilidad durante más de 1.000 ciclos.

Más allá de resolver este desafío técnico de este tipo de baterías, su relevancia radica en que esta batería no necesita litio, cobalto, níquel ni ningún otro metal crítico para funcionar. El sodio y el azufre son recursos abundantes en todo el mundo, lo que convierte esta tecnología en una alternativa más limpia, barata y escalable frente a las baterías de iones de litio convencionales, cuya cadena de suministro depende de materiales escasos y concentrados en muy pocos países.

Contexto. La dependencia del litio y los metales críticos no es solo un problema de coste: es una vulnerabilidad estratégica para Europa. El sodio y el potasio son significativamente más abundantes que el litio, lo que hace que los sistemas sodio – azufre sean más rentables y escalables para el almacenamiento en red a gran escala, una necesidad urgente en el contexto de la transición energética global.

A esto se suma el contexto agrícola del estado español: según el Ministerio de Agricultura, Pesca y Alimentación español, la producción de pistacho en España creció un 73% en el último año, impulsada también por las heladas de 2025 en Turquía e Irán, que arrasaron gran parte de la cosecha de los principales productores mundiales. Lógicamente, este aumento ha generado cada vez más volumen de cascaras como desecho sin aprovechamiento. El trabajo de IQUEMA no solo propone una batería alternativa, sino un modelo de economía circular que transforma ese residuo en un material de alto valor tecnológico.

Cómo lo han hecho. El proceso de fabricación del carbón activo sigue una ruta de síntesis relativamente sencilla. A partir de la cáscara de pistacho tratada con hidróxido de potasio a alta temperatura obtienen un carbón con una red de poros de tamaño nanométrico, tan pequeños que atrapan físicamente las moléculas de azufre y les impiden disolverse durante el funcionamiento de la batería.

El resultado es un carbón microporoso con grupos funcionales de oxígeno y nitrógeno integrados en su superficie, que no solo retiene el azufre mecánicamente sino que también interactúa con él químicamente, reforzando la estabilidad del cátodo durante más de 1.000 ciclos. El equipo de investigación destaca que la síntesis es sencilla y escalable, lo que abre la puerta a su fabricación industrial sin necesidad de equipos especializados ni materiales de difícil acceso.

Sí, pero. Los resultados electroquímicos son tremendamente prometedores, pero a escala de laboratorio. Las baterías de sodio y azufre se enfrentan a otros retos que este trabajo no resuelve, como la naturaleza aislante del azufre y el sulfuro de sodio, la expansión del volumen del cátodo o la formación de dendritas de sodio metálico en el ánodo y que tendrían que solucionarse para una futura comercialización.

La aplicación práctica de estas baterías sigue estando limitada por la degradación rápida de la capacidad y la baja conductividad del azufre y sus productos reducidos. En resumen: el invento da un paso importante, pero queda trabajo por delante en el ánodo y el electrolito antes de que esta tecnología pueda salir del laboratorio.

En Xataka | El pistacho ha obrado un prodigio inesperado: generar miles de empleos en los campos de Castilla-La Mancha

Portada | Theo Crazzolara y Newpowa

ues de anuncios individuales.

Source link

-

Musica2 días ago

Musica2 días agoAgenda: Los mejores eventos de entretenimiento del 8 al 14 de mayo 2026

-

Musica2 días ago

Musica2 días ago¿Qué son los ‘freebies’ y por qué se dan en los conciertos?

-

Deportes2 días ago

Deportes2 días agoLa multa del millón de dólares: Real Madrid castiga a Tchouaméni y a Valverde

-

Deportes2 días ago

Deportes2 días agoLa multa del millón de dólares: Real Madrid castiga a Tchouaméni y a Valverde

-

Actualidad2 días ago

Actualidad2 días agolos psicólogos ven algo mucho más profundo

-

Actualidad2 días ago

Actualidad2 días agoqué autos pueden circular y cuáles descansan el 9 de mayo

-

Deportes1 día ago

Deportes1 día agoEE.UU. no revisará redes de turistas durante el Mundial, afirma enviado especial

-

Actualidad2 días ago

Actualidad2 días agoEsposa de Gene Hackman murió por hantavirus un año antes del brote que alarma al mundo