Actualidad

una “fábrica” de moléculas clave para la vida

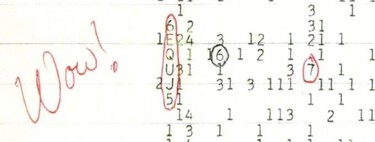

El Telescopio Espacial James Webb (JWST) nos ha regalado otra imagen para el recuerdo, pero esta vez, la belleza esconde un descubrimiento fundamental sobre la química del universo. Un equipo internacional de astrónomos ha utilizado el potente ojo infrarrojo del Webb para desentrañar la compleja estructura de NGC 6302, más conocida como la Nebulosa de la Mariposa.

Tratando de resolver una gran pregunta de la astrofísica. El equipo de científicos ha encontrado en esta nebulosa lo que podría ser la primera evidencia directa de un lugar de formación de hidrocarburos aromáticos policíclicos (PAH) en una nebulosa planetaria.

Estas moléculas, compuestas de carbono y fundamentales para la química prebiótica, son un ingrediente esencial en el cosmos, y entender dónde y cómo se crean es una de las grandes preguntas de la astrofísica.

Un rompecabezas químico en el corazón de la mariposa. La Nebulosa Mariposa, ubicada a unos 3.800 años luz de distancia, es el espectacular remanente de una estrella moribunda mucho más masiva que nuestro Sol. En su centro se encuentra una de las estrellas más calientes conocidas, con una temperatura superficial de aproximadamente 220.000 kelvins. Esta estrella bombardea con radiación ultravioleta los restos de gas y polvo que ella mismo expulsó, creando las intrincadas y luminosas ‘alas’ que le dan su característico nombre.

Sin embargo, NGC 6302 presentaba un enigma que traía de cabeza a los científicos. Su espectro mostraba la presencia simultánea de polvo rico en oxígeno (como los silicatos cristalinos) y de moléculas ricas en carbono (los PAH). Esto es extremadamente inusual, ya que la química de una estrella evolucionada suele decantarse por uno de los dos elementos, dependiendo de si en su atmósfera hay más carbono o más oxígeno. Encontrar ambos en abundancia era como mezclar agua y aceite.

El Webb enciende la luz en la oscuridad. Utilizando el instrumento MIRI (Mid-infrared Instrument) del JWST, los investigadores liderados por Mikako Matsuura de la Universidad de Cardiff, lograron crear un mapa químico detallado del corazón de la nebulosa, una zona densa y oscurecida por el polvo.

Este mapa se mereció un artículo en la revista Monthly Notices of the Royal Astronomical Society donde se revelaba una estructura mucho más dinámica y compleja de lo que se pensaba.

Un tesoro astronómico. El estudio confirmó la existencia de un denso disco de polvo y gas que rodeaba a la estrella central. Y el disco es un auténtico tesoro, pues no solo contiene una masa enorme (entre 0,8 y 3 veces la masa de nuestro Sol), sino que está compuesto por granos de silicatos cristalinos de gran tamaño.

Esto apoya la teoría de que este polvo se formó en un entorno de alta intensidad y de forma lenta, condiciones que se darían en un disco estable, quizás influenciado por una estrella compañera, y no en el viento estelar rápido y caótico.

Burbujas violentas y una fábrica de PAH. Uno de los hallazgos más sorprendentes es que la nebulosa no se está formando por un viento estelar continuo y suave. En su lugar, Webb revela que la estrella central ha generado una serie de ‘burbujas’ de gas caliente en expulsiones violentas e intermitentes. Es precisamente en el borde de una de estas “burbujas internas” donde se produjo el momento “eureka”. Los científicos observaron una clara estratificación de los materiales.

En concreto, se vio una capa interna de gases altamente ionizados, como el magnesio y el silicio, muy cerca de la estrella. Más afuera una capa de hidrógeno ionizado. Y coincidiendo con esta capa, o ligeramente más afuera, una capa de hidrógeno molecular. Pero lo más interesante es que la emisión de los hidrocarburos aromáticos policíclicos (PAH) se encuentra todavía más al exterior de las capas.

Algo inusual a lo ya conocido. Esta disposición es diferente a la de otras regiones de formación estelar bien estudiadas, como la Barra de Orión. Los investigadores argumentan que la onda de choque generada por la expansión de la burbuja caliente crea las condiciones perfectas de radiación y temperatura en el material que tiene justo delante.

Este frente de choque desencadena una química que permite la formación de moléculas PAH en esa franja específica. En lugar de ser restos del pasado de la estrella, estas moléculas complejas se estarían fabricando ahora mismo, como resultado de la violenta dinámica de la nebulosa.

¿Por qué es importante? Con esta investigación se ha podido dar un primer paso para descifrar el origen de moléculas complejas en nuestro universo, que se consideran bloques de construcción fundamentales para los precursores de la vida. Entender dónde y cómo se fabrican en el cosmos es crucial para comprender el ciclo del carbono en el universo y la disponibilidad de ingredientes prebióticos en las galaxias que den una nueva vida.

El estudio también demuestra que la Nebulosa de la Mariposa no se formó por un viento estelar suave y continuo, sino por una serie de estallidos violentos y energéticos. Esto cambia nuestra comprensión sobre cómo mueren las estrellas como el Sol y cómo devuelven sus elementos al espacio, demostrando que la fase final de la vida de una estrella puede ser un proceso mucho más dinámico de lo que se pensaba.

Imágenes | NASA

ues de anuncios individuales.

Source link

Actualidad

la memoria ya no quiere vivir en cada máquina

Para muchos de nosotros, la escasez de memoria puede sonar primero a un problema cercano al consumo doméstico: módulos de RAM, componentes y dispositivos condicionados por una demanda cada vez más tensionada. Pero el fenómeno que describe The Next Platform apunta también al otro extremo de la cadena. Alcanza a las grandes tecnológicas que entrenan, despliegan y ofrecen modelos de inteligencia artificial en centros de datos. La nube no es una abstracción, y su apetito de memoria está obligando a pensar algo que hasta hace poco parecía poco intuitivo: quizá cada máquina no deba depender solo de la RAM que lleva dentro.

La memoria cambia de sitio. La idea de fondo es trasladar a la memoria una lógica que ya nos resulta familiar con el almacenamiento. Hoy un dato puede vivir en el propio equipo, en otra máquina de la red o en un sistema compartido al que acceden varios servidores. La próxima generación de servidores podría tratar la RAM de una forma parecida: conservar una parte local en cada máquina, pero llevar una porción mucho mayor a grandes sistemas externos capaces de repartir capacidad según la necesidad de cada momento. De ahí sale lo que algunos llaman “memory godbox”: una gran caja o clúster de memoria que deja de estar atado a una sola máquina.

El momento de CXL. Durante años, Compute Express Link ha avanzado de forma lenta, casi como una promesa para arquitecturas más flexibles. La tecnología se presentó hace varios años, pero la presión actual de la memoria le está dando un contexto mucho más favorable. CXL proporciona una interfaz coherente para comunicar procesadores, memoria, aceleradores y otros periféricos, apoyándose en PCIe. La idea final es sencilla de contar, aunque compleja de ejecutar: separar recursos sin romper la sensación de que trabajan juntos.

CXL no llegó de golpe. Primero sirvió para ampliar la memoria de un servidor mediante módulos conectados a ranuras PCIe compatibles. Después, con CXL 2.0, apareció el pooling, es decir, la posibilidad de reunir memoria en un fondo común y asignarla a distintas máquinas según hiciera falta. El límite era que esa memoria podía reasignarse, pero no compartirse de verdad entre dos sistemas trabajando sobre los mismos datos. CXL 3.0 es el punto en el que esa frontera empieza a moverse, porque introduce topologías más amplias y memoria compartida entre máquinas, aunque con ciertas limitaciones técnicas.

El problema de fondo. Según The Next Platform, la IA no se queda corta solo por falta de cálculo, también por falta de memoria. La HBM que acompaña a las GPU es muy rápida y está pensada para alimentar esos chips a gran velocidad, pero su capacidad es limitada y su coste es alto. En entrenamiento, el gran reto suele estar en procesar cantidades enormes de datos para construir el modelo. En inferencia, en cambio, hablamos de otra cosa: usar ese modelo ya entrenado para responder a una petición.

La memoria de la conversación. Cada respuesta de un modelo de lenguaje se construye poco a poco, token a token. Para no recalcular todo lo anterior en cada paso, los sistemas guardan una especie de memoria de trabajo llamada KV cache. The Next Platform explica que ahí se conservan los vectores de atención previos, que ayudan al modelo a seguir teniendo en cuenta el contexto mientras genera la respuesta. El problema es que en servicios con muchos usuarios esa caché puede crecer hasta ocupar cantidades enormes de memoria, incluso más que el propio modelo.

Ya no es solo teoría. Esta idea ya no vive solo en documentos técnicos o promesas de arquitectura. The Register menciona a Panmnesia, Liqid y UnifabriX como compañías que trabajan en sistemas para llevar memoria fuera del servidor y ponerla al alcance de varias máquinas. Algunos lo hacen con switches CXL, otros con grandes reservas de DDR5 que pueden repartirse entre distintos hosts. The Next Platform añade el caso de Enfabrica y su sistema Emfasys, pensado para inferencia y capaz, según el medio, de alcanzar 18 TB de DDR5 por servidor de memoria y 144 TB en un rack completo. La conclusión es sencilla: la industria no solo busca más memoria, busca colocarla de otra manera para que la IA pueda aprovecharla mejor.

Imágenes | Xataka con Nano Banana

ues de anuncios individuales.

Source link

Actualidad

Mozilla acaba de revelar cuántas veces fue elegido Firefox

Durante años, elegir navegador ha sido una de esas decisiones que parecían estar en nuestras manos, pero que en la práctica venían bastante condicionadas por el dispositivo que sacábamos de la caja. En el iPhone estaba Safari. En muchos móviles Android, Chrome. Y aunque siempre hemos podido instalar alternativas, lo cierto es que cambiar un ajuste escondido no es lo mismo que recibir una pregunta clara en el momento adecuado. Esa es precisamente la grieta que la Ley de Mercados Digitales (DMA) ha intentado abrir en Europa: convertir una elección teórica en una decisión visible.

El dato que pone cifras. Mozilla asegura que, desde que las obligaciones de la DMA empezaron a aplicarse en marzo de 2024, Firefox acumula más de seis millones de selecciones a través de las pantallas de selección de navegador. Según la organización que desarrolla el navegador, eso equivale a una elección cada 10 segundos. El movimiento no se queda solo en la descarga o en la instalación: también afirma que la retención es cinco veces mayor cuando los usuarios llegan a Firefox por esa vía.

La diferencia. El salto, eso sí, no ha sido igual en todos los dispositivos. Mozilla cita un análisis académico que compara usuarios activos diarios de Firefox en la UE con 43 países no comunitarios y sitúa el impacto en iOS muy por encima del de Android: un 113% más de lo que cabría esperar sin la DMA frente a un 12%. Un dato a tener en cuenta: en iPhone y iPad la pantalla aparece al abrir Safari por primera vez, mientras que en Android se muestra al iniciar un dispositivo nuevo o tras restablecerlo de fábrica. Mozilla añade que, en Android, Firefox partía de una base de uso más alta y que el despliegue ha sido más desigual.

¿Una victoria real? En su publicación, Mozilla insiste en que la DMA está dando frutos en algunos ámbitos, pero “no en todas partes, no de forma perfecta y no sin aplicación efectiva”. Ese matiz importa porque las pantallas de elección no eliminan por sí solas años de integración vertical, ajustes por defecto y hábitos de uso. TechCrunch señalaba en 2024 como Aloha, Brave, Opera y Vivaldi, también registraron de subidas importantes en los primeros días y semanas posteriores a la aplicación de la norma europea.

El móvil se mueve, el escritorio no tanto. Para Mozilla, el avance en móviles deja una pregunta pendiente: qué ocurre con los ordenadores. La organización sostiene que el escritorio sigue “en gran medida intacto” y calcula que unos 310 millones de sobremesa y portátiles en la UE no tienen una pantalla de selección equivalente. Su crítica se dirige especialmente a Windows, donde, según Mozilla, los usuarios están expuestos a tácticas de diseño engañoso y no reciben una elección activa.

Más allá de los números. Lo anunciado por Mozilla nos deja información valiosísima: cuando la elección aparece delante del usuario, la inercia deja de ser tan automática. No significa que todos vayan a abandonar Chrome o Safari, ni que las pantallas de selección solucionen por sí solas los problemas de competencia digital. Pero sí apunta a algo medible: si la alternativa se muestra de forma clara, hay usuarios que la escogen.

Imágenes | Xataka con Nano Banana

ues de anuncios individuales.

Source link

Actualidad

El próximo tratamiento contra la depresión podría estar en los ojos. Ya han probado con éxito unas lentillas inteligentes en ratones

La depresión que resiste a los fármacos es uno de los mayores desafíos de la medicina actual, puesto que cuando los antidepresivos no funcionan, la psiquiatría y la neurología tienen que recurrir a terapias como la electroconvulsión. Ahora, un equipo de investigadores ha dado un giro radical a este asunto al desarrollar unas lentes de contacto inteligentes capaces de tratar la depresión estimulando el cerebro a través de la retina.

Un estudio publicado en la revista Cell muestra unos muy buenos resultados en modelos de ratón con el uso de estas lentillas que han permitido revertir el fenotipo depresivo con una capacidad comparable a la del antidepresivo fluoxetina, o más conocido como Prozac.

No es invasivo. Para entender el hito que supone este estudio, hay que mirar primero las terapias actuales que pasan por usar la conocida como Estimulación Magnética Transcraneal para poder hacer una neuromodulación no invasiva para pacientes con depresión resistente a los fármacos. También se está estudiando la posibilidad de hacer estimulaciones eléctricas transcraneales por corriente continua.

Pero el problema de estas terapias que están en el último escalón de la psiquiatría es que llegar a las regiones profundas del cerebro sin recurrir a la cirugía es extremadamente difícil. Y es que uno de los riesgos de aplicar un campo eléctrico fuerte desde el exterior para llegar a la profundidad del cerebro puede acabar dañando parte del cerebro.

La solución. Ante este inconveniente físico es donde entra la tecnología de interferencia temporal. Tal y como detalla una revisión hecha en 2025, esta estimulación es una gran estrategia, puesto que consiste en aplicar dos corrientes eléctricas de alta frecuencia que no afectan al tejido cerebral superficial.

De esta manera, al cruzarse en las zonas profundas del cerebro, la diferencia de frecuencia crea una nueva onda de baja frecuencia que sí estimula las neuronas objetivo. Es un concepto funcional que fue demostrado por primera vez en ratones y que permite acceder a lo más profundo de nuestra anatomía sin bisturí.

Unas lentillas. Bajo este principio es donde ahora se está buscando la forma de aplicarlo de una manera cómoda para el paciente y es donde entra en juego el uso de lentillas equipadas con electrodos fabricados con óxido de galio y platino. Aquí se aprovecha la conexión anatómica directa que existe entre el ojo y el cerebro a través del nervio óptico para conseguir transmitir esta estimulación a través de la retina que permite enviar señales de interferencia temporal hasta las redes neuronales implicadas en la depresión.

La aplicación. En la investigación simplemente se aplicó esta estimulación durante 30 minutos al día a lo largo de tres semanas en los roedores. Lo que se consiguió aquí es una restauración de las oscilaciones cerebrales saludables y una mejoría conductual que, según los investigadores, es equiparable a la obtenida mediante la administración de fluoxetina en estos mismos modelos animales.

Cautela. Aquí hay que tener en cuenta que esta es la primera vez que se usan unas lentillas para tratar un trastorno cerebral, y aunque el diseño del dispositivo es un alarde de la ingeniería, hay que ser cautos. Como suele ocurrir con estos avances, el paso del laboratorio al paciente va muy lento por la necesidad de numerosos ensayos para valorar el efecto y la seguridad en humanos. Pero la idea ahora mismo ya está sobre la mesa y solo hay que esperar que la ciencia siga avanzando.

Imágenes | rawpixel.com en Magnific

ues de anuncios individuales.

Source link

-

Tecnologia1 día ago

Tecnologia1 día agoCambio climático dispara el riesgo por calor y humedad en el Mundial 2026

-

Tecnologia1 día ago

Tecnologia1 día agoLanzamiento masivo de satélites llena de hollín la atmósfera superior

-

Musica2 días ago

Musica2 días agoConciertos: ¡Aguante Megadeth!”: Guadalajara vive una despedida histórica del thrash metal

-

Actualidad2 días ago

Actualidad2 días ago“¡Nos están disparando!”: Rihanna detalla en documentos judiciales el momento del tiroteo contra su casa

-

Actualidad2 días ago

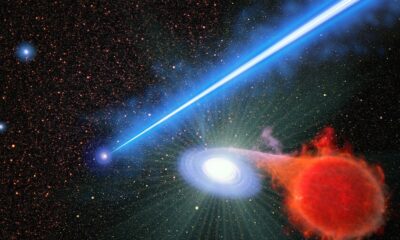

Actualidad2 días agoLos chorros de energía de los agujeros negros son tan potentes que pueden remodelar galaxias enteras y ahora sabemos cómo medirlo

-

Musica2 días ago

Musica2 días agoMúsica: “KPop Demon Hunters” tendrán gira mundial en 2027

-

Actualidad1 día ago

Actualidad1 día agoHay gente muy enfadada por las inexactitudes de ‘La Odisea’ de Nolan. Pero no por los uniformes: por la diversidad

-

Deportes2 días ago

Deportes2 días agoMuere Jason Collins, primer jugador de la NBA que se declaró homosexual