Escrito en ENTRETENIMIENTO el

Actualidad

enseñar a la IA a sonar humana

En los últimos meses, muchos hemos hablado con una inteligencia artificial sin pensarlo demasiado. Le hemos preguntado dudas, le hemos pedido consejo o simplemente hemos probado hasta dónde llega su capacidad para mantener una conversación natural. Herramientas como los modos de voz de ChatGPT o Gemini han acercado esa experiencia a algo que, hace no tanto, parecía reservado a la ciencia ficción, con ecos inevitables de ‘Her’. Pero hay una pregunta que rara vez nos hacemos mientras hablamos con ellas: cómo han aprendido estas máquinas a sonar cada vez menos como un sistema y más como una persona.

Para entenderlo, conviene separar lo que vemos de lo que no vemos. Por un lado están las aplicaciones que usamos a diario, esos asistentes que responden con una voz cada vez más natural. Por otro, los sistemas que las sostienen, modelos entrenados con grandes volúmenes de datos que necesitan aprender no solo qué decir, sino también cómo decirlo. No sabemos qué productos concretos terminan utilizando este tipo de grabaciones, pero sí que forman parte del ecosistema con el que se entrenan sistemas de voz cada vez más fluidos y verosímiles.

La mano humana detrás de una voz artificial

Cuando bajamos al detalle, lo que hacen estos trabajadores no se parece demasiado a la idea clásica de “entrenar una IA”. En muchos casos, se trata de mantener conversaciones con desconocidos sobre temas aparentemente triviales, desde gustos cotidianos hasta preguntas abiertas que obligan a desarrollar una respuesta. En otros, el encargo es más exigente: interpretar un papel, seguir un guion sin que lo parezca o entrar en terrenos emocionales. Bloomberg cuenta, por ejemplo, el caso de una trabajadora que relató recuerdos dolorosos de su vida mientras hablaba con un hombre que se presentaba como pastor y que, dentro del ejercicio, interpretaba el papel de terapeuta.

Todo ese material grabado sirve para algo muy concreto: capturar matices. No hablamos solo de palabras, sino de pausas, respiraciones, cambios de tono, vacilaciones o reacciones emocionales que hacen que una conversación suene humana. También hay tareas de etiquetado, en las que los trabajadores tienen que distinguir si un audio contiene un sollozo, una carcajada o a alguien hablando entre risas. La lógica de fondo es sencilla: si una máquina quiere dejar de sonar robótica, antes necesita exponerse a cómo hablamos de verdad.

Tras superar una prueba inicial de voz, pueden optar a tareas que arrancan en unos 17 dólares por hora grabada.

A partir de ahí, la pregunta es inevitable: cómo se accede a este tipo de trabajo y cuánto se gana realmente. Plataformas como Babel Audio funcionan como intermediarias que conectan a estos trabajadores con proyectos concretos. Tras superar una prueba inicial de voz, pueden optar a tareas que arrancan en unos 17 dólares por hora grabada, aunque el ingreso final depende de la evaluación recibida y del volumen de encargos disponible. Los ingresos, además, varían mucho: una trabajadora citada por el mencionado medio asegura ingresar unos 600 dólares semanales.

Así se ve la página web de BabelAudio

A medida que avanzamos, el trabajo empieza a mostrar una cara menos visible. Más allá de las tarifas y de la promesa de flexibilidad, los testimonios apuntan a un entorno marcado por la incertidumbre y el control constante. Las plataformas pueden limitar el acceso a tareas, interrumpir proyectos o suspender cuentas sin explicaciones detalladas, lo que deja a muchos trabajadores en una posición frágil. Además, cada conversación está sometida a métricas en tiempo real que valoran si alguien habla demasiado o demasiado poco, la expresividad, el dominio del idioma, la profundidad del intercambio y hasta la duración de las pausas.

Cuando ampliamos el foco, el debate deja de ser únicamente laboral y pasa a ser también personal. Parte del valor de estas grabaciones reside precisamente en que capturan cómo hablamos y cómo nos relacionamos, lo que implica que los trabajadores están aportando algo más que una tarea mecánica. Las condiciones generalmente permiten usar esas grabaciones en asistentes de voz, síntesis de habla y “otros productos y servicios relacionados con el audio”.

Cuando conectamos todas las piezas, lo que vemos es una industria que funciona gracias a una cadena de producción compleja. El Pulitzer Center describe este ecosistema como una red de trabajo fragmentado en la que los trabajadores suelen estar sometidos a acuerdos de confidencialidad, operan con muy poca transparencia y, en muchos casos, ni siquiera saben qué sistema están entrenando ni para qué empresa acaba yendo su trabajo. En ese contexto, las conversaciones que alimentan a los sistemas de voz son solo una parte de un engranaje mayor, donde cada tarea contribuye a construir tecnologías cada vez más sofisticadas.

Imágenes | Xataka con Nano Banana 2 | Captura de pantalla

ues de anuncios individuales.

Source link

Actualidad

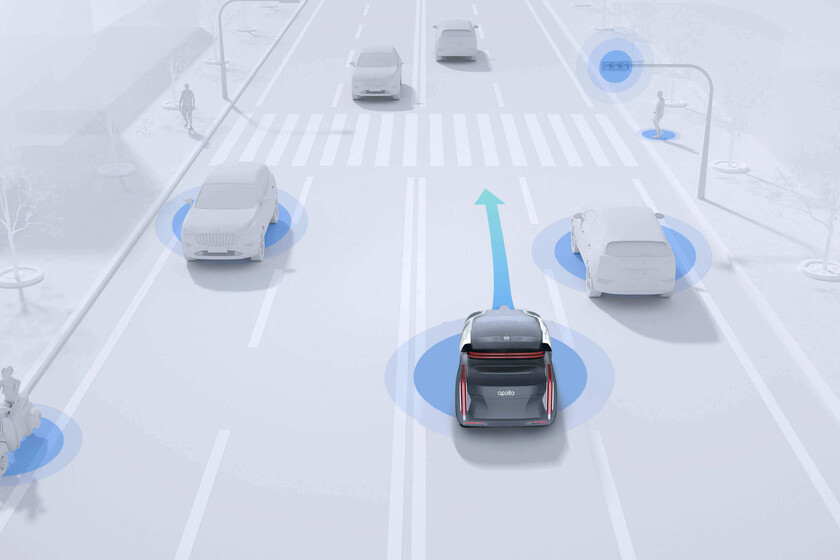

China lleva años presumiendo de sus robotaxis sin conductor. Hasta que más de 100 se han parado a la vez en Wuhan

La pantalla del interior decía: “Fallo en el sistema de conducción. El personal llegará en cinco minutos”. Pero nadie llegó. La pasajera pulsó el botón de SOS y le dijeron que iban de camino, pero tardó 30 minutos solo en conseguir que alguien cogiera el teléfono. Mientras tanto, el robotaxi seguía parado en mitad de un carril de Wuhan, con el tráfico pasando a ambos lados.

Eso es lo que ha ocurrido en la noche del martes 1 de abril en la ciudad china de Wuhan: más de cien coches autónomos de Apollo Go, la filial de robotaxis de Baidu, han dejado de funcionar al mismo tiempo por un fallo del sistema. Es la primera vez que se produce un apagón colectivo de robotaxis en China, y ha dejado al descubierto una preocupación que el sector lleva tiempo esquivando.

Por qué es importante. Baidu no es un actor menor. Apollo Go opera más de 1.000 robotaxis solo en Wuhan, su mayor despliegue, y ha acumulado ya más de 20 millones de viajes en su historia. La empresa acaba de arrancar en Abu Dabi y Dubái, las dos grandes ciudades de Emiratos Árabes Unidos; está negociando su entrada en Reino Unido y Suiza, y tiene un acuerdo con Uber para operar a través de su app.

Un incidente de esta magnitud no llega en cualquier momento: llega cuando la empresa, como todo su sector, está intentando convencer al mundo de que está listo para escalar.

Entre líneas. Técnicamente, el incidente podría explicarse de muchas formas. Algunos medios chinos citaron fuentes anónimas que apuntaron a los sistemas de autoverificación de seguridad, que habrían detectado alguna condición anómala y detenido los vehículos de forma preventiva.

Si así fuera, el sistema habría funcionado exactamente como estaba diseñado, pero el resultado ha sido caótico: coches parados en carriles centrales de vías rápidas, algunos pasajeros atrapados durante más de 90 minutos, colisiones provocadas por vehículos que frenaron de golpe en autopistas…. Que nadie haya resultado herido es casi una cuestión de suerte.

El contraste. No es el único precedente. En diciembre de 2025, un apagón eléctrico en San Francisco dejó a los robotaxis de Waymo inmovilizados por toda la ciudad, obligando a la Waymo a enviar actualizaciones de software para toda su flota.

Meses antes, en agosto, un Apollo Go cayó a una zanja en Chongqing; en mayo, un coche de Pony.ai salió ardiendo en Pekín, sin causar heridos. Es fácil ver cierto patrón: la conducción autónoma a gran escala no ha alcanzado aún la fiabilidad que necesita para justificar la confianza que se le está pidiendo al público.

Y ahora qué. Que los coches se paren es un problema, pero aún mayor es es el problema de que nadie sepa por qué. Baidu no ha explicado qué ha causado el fallo ni cuánto tardaron en resolverlo. La policía de Wuhan ha confirmado el incidente pero sin dar más detalles sobre la causa.

Esa opacidad pesa tanto o más que el incidente, sobre todo si hablamos de un sector que lleva años argumentando que sus coches son más seguros que los conducidos por humanos. Asumimos que es muy cierto, pero fallos en bloque como este no invitan al optimismo sin preguntas.

Imagen destacada | Baidu – Apollo

En Xataka | Los coches autónomos de Waymo han empezado a tocarse el claxon unos a otros. A las 4 de la madrugada

ues de anuncios individuales.

Source link

Actualidad

Juez en Nueva York desecha la mayoría de las acusaciones de Blake Lively contra Justin Baldoni

EFE.- Un juez federal de Nueva York desestimó este jueves la mayoría de las acusaciones en la demanda por acoso sexual interpuesta por la actriz Blake Lively contra el actor y director Justin Baldoni en 2024.

En su fallo judicial, el magistrado Lewis J. Liman desestimó diez de las trece acusaciones vertidas por Lively contra Baldoni, entre ellas acoso, difamación y conspiración, y mantuvo las de incumplimiento de contrato, represalias y complicidad en represalias.

Liman indicó que Lively se basaba en su demanda en una ley de acoso sexual de California, cuando los hechos de los que acusa a su compañero tuvieron lugar presuntamente en Nueva Jersey, en un estudio donde se grabaron algunas escenas de la película “It Ends With Us” (“Romper el círculo”).

El juez indicó, no obstante, que “hay ciertas conductas (de Baldoni) que, podría considerarse, traspasaron los límites“.

“Hay límites en la respuesta que el acusado puede dar ante las denuncias de acoso. Llega un momento en que (Baldoni) deja de limitarse a defenderse y empieza a tomar medidas que un jurado razonable podría considerar una represalia por el hecho de que la denunciante presentara las acusaciones”, subrayó.

Lively y Baldoni, compañeros de reparto en la película “Romper el círculo”, se enfrentarán en un juicio el próximo 18 de mayo en un tribunal de Manhattan.

La actriz demandó a Baldoni por comportamiento inapropiado durante el rodaje y por presuntamente llevar a cabo una campaña de desprestigio en represalia, unas acusaciones que él ha negado desde el principio.

Baldoni contrademandó a Lively por 400 millones de dólares, pero un juez desestimó esa causa el pasado 9 de junio, al igual que su demanda por difamación de 250 millones de dólares contra The New York Times, medio que publicó las acusaciones de Lively.

Según documentos judiciales divulgados el pasado noviembre, Lively estima en 161 millones de dólares sus pérdidas por esta presunta campaña de descrédito.

ues de anuncios individuales.

Source link

Actualidad

China dice haber construido su mayor centro de datos. Y confirma que su problema está precisamente en los chips

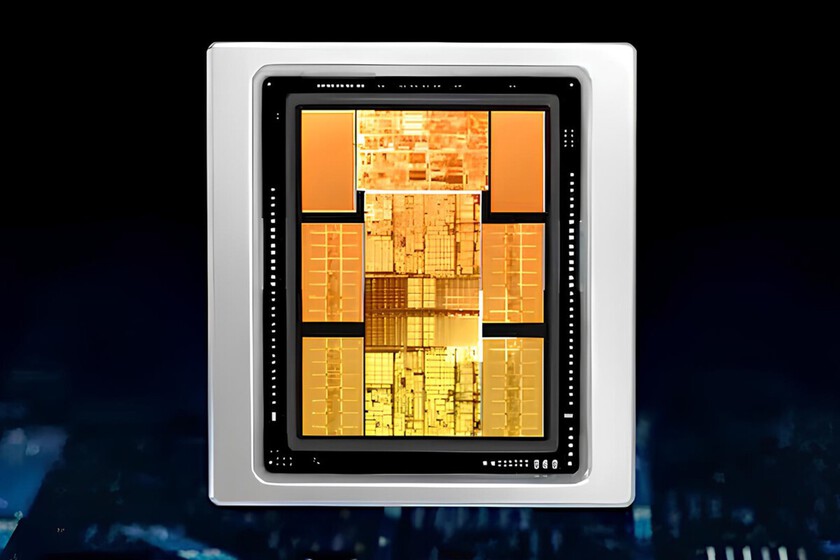

China acaba de encender en Shenzhen su nuevo orgullo tecnológico: un clúster de IA con 14.000 petaflops construido íntegramente con chips Huawei Ascend 910C.

La ciudad lo ha presentado como el primer centro de computación a escala con 10.000 tarjetas con tecnología completamente nacional. Es un hito innegable, pero si le damos contexto, una señal de alarma y una dosis de realidad.

Por qué es importante. El clúster de Shenzhen, con toda su retórica de soberanía tecnológica, representa aproximadamente el 1% de la capacidad del mayor centro de datos estadounidense en operación hoy.

Dicho de otra forma: China ha construido, con un gran esfuerzo institucional, lo que OpenAI ya tenía disponible para entrenar GPT-4 en 2022. La brecha no es una cuestión de ambición (China la tiene) ni de capital (también lo tiene) ni de energía (por supuesto, también la tiene). Es una cuestión de chips. De qué son capaces de fabricar y en qué volumen a día de hoy.

Entre líneas. El comunicado del gobierno de Shenzhen destaca métricas de eficiencia energética y tasas de ocupación del 92%. Son datos realmente buenos. Pero la selección de indicadores (el cherry picking) dice mucho por lo que se omite: no hay comparaciones directas con los clústeres de NVIDIA H100 que colonizan los centros de datos de Microsoft, Google o Amazon.

Publicar solo lo que tienes es también una forma de no publicar lo que te falta.

El contexto. A estas alturas ya nadie duda de que China no carece de electricidad, ni de ingenieros, ni de dinero para construir infraestructura de IA a gran escala. Lo que le sigue faltando, pese a los avances, son los chips.

Las restricciones a la exportación impuestas por Trump le han cortado el acceso a los semiconductores avanzados de NVIDIA y TSMC, y eso ha forzado a China a acelerar su propio ecosistema.

- Huawei ha respondido con el Ascend 910C, un chip capaz pero que aún arrastra limitaciones de rendimiento y, sobre todo, de producción en volumen.

- Si las obleas no escaseasen, este centro de datos sería cien veces más grande.

Sí, pero. ¿Puede China cerrar esa brecha de cuatro años antes de que se haga aún más grande? La respuesta depende casi por completo de cuánto logre escalar su industria doméstica de semiconductores, y de si las sanciones occidentales consiguen o no ahogar ese proceso.

De momento, en Shenzhen están celebrando un logro tan innegable como innegable resulta que a ojos de Silicon Valley siguen en 2022.

Imagen destacada | Huawei

ues de anuncios individuales.

Source link

-

Deportes1 día ago

Deportes1 día agoMundial 2026: Decretan en Congo día no laborable y remunerado para celebran clasificación mundialista | Video

-

Musica2 días ago

Musica2 días agoTaylor Swift es demandada por presunto plagio en The Life of a Showgirl

-

Actualidad17 horas ago

Actualidad17 horas agoSpaceX está a punto de salir a bolsa prometiendo llevar la IA al espacio. Lo que realmente vende es Internet por satélite

-

Actualidad1 día ago

Actualidad1 día agoJapón avanza como una apisonadora en la industria de los chips. Ya mira hacia los 1,4 nm y amenaza el dominio de Taiwán

-

Musica2 días ago

Musica2 días agoShakira entra al top 5 del Rock Hall 2026

-

Actualidad2 días ago

Actualidad2 días agoRenfe, Iryo y Ouigo subieron los precios a lo bestia en 2025. Ahora están sufriendo las previsibles consecuencias

-

Tecnologia19 horas ago

Tecnologia19 horas agoNASA transmitirá en español el lanzamiento de Artemis II a la Luna; ¿dónde verlo?

-

Tecnologia5 horas ago

Tecnologia5 horas agoAlertan por sitios web falsos de aerolíneas y hoteles