Actualidad

también cambió la ingeniería para siempre

Poco antes de las 11:00 de la mañana del 7 de noviembre de 1940, un impresionante puente colgante de Estados Unidos estaba a minutos de convertirse en historia de la ingeniería. En aquella mole solo quedaba un perro atrapado al que nadie podía salvar. Pasados unos minutos de las 11, las cámaras filmaron una de las escenas más impactantes jamás grabadas.

Esta fue la historia de un fallo descomunal.

Una obra maestra demasiado ligera. Cuando el puente Tacoma Narrows abrió en julio de 1940, su silueta fina y elegante pretendía simbolizar una nueva era de ingeniería económica y eficiencia estructural. Leon Moisseiff, uno de los ingenieros más prestigiosos del país y artífice del Golden Gate, había diseñado un coloso estilizado que, sin embargo, desde el primer día comenzó a mostrar un comportamiento inquietante: el tablero vibraba y se ondulaba incluso con brisas moderadas.

Los trabajadores bautizaron a la estructura como “Galloping Gertie”, un apodo tan coloquial como revelador, porque indicaba que algo profundo y aún incomprendido estaba perturbando su estabilidad.

Primeras pesquisas. Los equipos de la Universidad de Washington iniciaron estudios intensivos: modelos a escala, pruebas en túnel de viento y soluciones de emergencia como gatos hidráulicos y cables provisionales. Nada logró detener las oscilaciones.

El puente, demasiado delgado, demasiado ligero, demasiado fiel a una estética depurada, había sido empujado al límite por la filosofía de diseño de la Gran Depresión, una en la que los materiales se reducían a lo imprescindible y la resistencia aerodinámica no era aún una ciencia madura.

El desastre. El 7 de noviembre de 1940, con vientos de alrededor de 65 km/h, Gertie experimentó lo que investigación definió como “una transición abrupta entre las oscilaciones verticales habituales y un violento movimiento torsional que pronto se volvió ingobernable”. Automovilistas y reporteros vivieron escenas que parecían extraídas de un relato fantástico: tramos del suelo que desaparecían bajo los pies, saltos en el vacío entre ondulaciones, y un ritmo de torsión que se intensificaba hasta que la estructura se plegó sobre sí misma.

A las 11:02 de la mañana, el centro del puente cayó al estrecho. La única víctima fue Tubby, un perro atrapado en un coche abandonado. El espectáculo, filmado con una nitidez escalofriante, se convirtió en uno de los documentos visuales más influyentes de la ingeniería moderna.

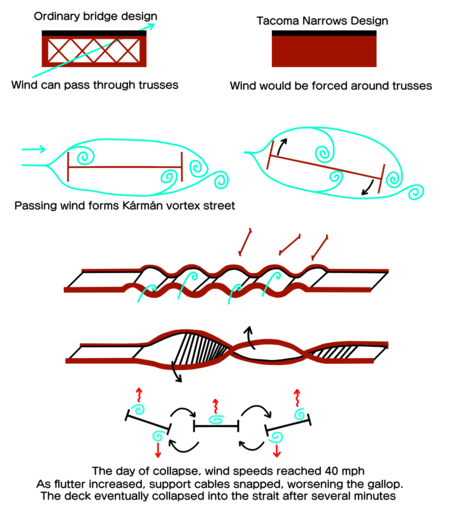

Qué demonios pasó. Tras la caída, las investigaciones determinaron que el colapso se debió a un fenómeno desconocido entonces en su complejidad: el denominado como flutter torsional. Cuando una de las suspensiones cedió, el tablero adoptó una geometría asimétrica que permitió que el viento alimentara la torsión del puente.

La estructura dejó de ser agitada por la atmósfera: era su propio movimiento el que generaba la fuerza destructiva, no el viento. La oscilación, “autoexcitada”, creció sin límite hasta provocar la fractura total. Aquella tragedia enterró la teoría clásica de la “deflexión”, que sostenía que solo los movimientos verticales eran relevantes en un puente colgante, y obligó a desarrollar nuevos principios aerodinámicos y un estándar riguroso de pruebas en túnel de viento que desde entonces se aplican en todo el mundo.

Día de la apertura del puente en 1940

Reconstrucción y corrección. En los años posteriores, Estados Unidos reescribió los manuales de ingeniería de puentes. Se diseñó un reemplazo más robusto, con un esqueleto más ancho, cables más pesados y rejillas abiertas para reducir la acción del viento. “Sturdy Gertie”, inaugurado en 1950, corrigió los errores conceptuales de su predecesora y se convirtió en el símbolo de una lección aprendida a través de la catástrofe.

Décadas después, en 2007, se añadió un nuevo tramo para absorber el tráfico creciente. Y mientras los ingenieros construían un puente más seguro en la superficie, el mundo submarino comenzó a reclamar los restos del puente original, que yacían dispersos a más de 60 metros bajo las aguas del Puget Sound.

Día del colapso

Metamorfosis inesperada. De forma extraordinaria, lo que comenzó como un naufragio accidental terminó convirtiéndose en uno de los arrecifes artificiales más extensos y singulares del Pacífico Noroeste. En las profundidades del estrecho, vigas retorcidas y placas metálicas en ruinas se cubrieron de anémonas, esponjas, algas y capas de organismos que transformaron la tragedia en un hervidero de vida submarina.

Anguilas lobo serpenteaban a través de los nudos del acero, pulpos gigantes del Pacífico hallaban refugios en los pliegues del tablero colapsado, y escuelas de peces rondaban los escombros. Para los buzos, era un paisaje casi mítico: un bosque de metal colonizado por la vida marina, tan exuberante que dio pie a la leyenda de un gigantesco “Rey Pulpo” que, según los habitantes de Tacoma, reinaba en las sombras bajo el puente. La magia de aquel ecosistema accidental residía en que la naturaleza tomó un vestigio de la ingeniería humana y lo convirtió en un santuario.

Representación del colapso del puente Tacoma Narrows

Legado amenazado. Sin embargo, a medida que pasaron las décadas, el entorno cambió de forma inquietante. Diversos testigos que bucearon en los noventa describen un vergel submarino rebosante de fauna, pero hoy, la mayor parte de ese esplendor ha desaparecido. La sobrepesca, combinada con cambios ecológicos en el Puget Sound, ha reducido drásticamente la presencia de especies emblemáticas.

Las criaturas marinas y pulpos gigantes han migrado a zonas menos explotadas, los peces son más pequeños y en muchos tramos solo quedan restos de anzuelos y aparejos. Los puntos menos castigados son, paradójicamente, los que se encuentran bajo el puente actual, donde la pesca es complicada y la vida marina resiste. Aun así, para muchos expertos, el deterioro del arrecife artificial es un recordatorio de la vulnerabilidad de los ecosistemas creados involuntariamente y de cómo la intervención humana (en tierra o en mar) define la vida que prospera o desaparece.

Historia, memoria y protección. Los restos de Galloping Gertie fueron incluidos en el Registro Nacional de Lugares Históricos en los años noventa, no solo como evidencia de un hito de ingeniería fallida sino también como testimonio de la capacidad de la naturaleza para transformar ruinas en hábitats. Hoy algunos defensores aspiran a un estatus aún mayor: convertir el sitio en una reserva marina, protegida contra actividades extractivas y reconocida tanto como patrimonio ecológico como capítulo fundamental de la historia de la ingeniería.

Un fracaso extraordinario. Si se quiere también, la historia del Tacoma Narrows no es solo la del colapso de un puente, sino la de una doble transformación: la del conocimiento ingenieril, que evolucionó a raíz del desastre, y la del ecosistema submarino que emergió de los escombros. El derrumbe impulsó cambios globales en la manera en que se diseñan y prueban las grandes estructuras. Los restos, por su parte, generaron un refugio biológico cuya conservación hoy se debate con urgencia.

Entre ambas dimensiones, técnica y biológica, hay una lección perdurable: los errores humanos pueden ser devastares, pero también pueden, sin proponérselo, sembrar las condiciones para que la vida florezca de formas inesperadas.

Imagen | Wikimedia Commons

En Xataka | China ha construido el puente más alto del mundo y ha hecho lo que debe: convertirlo en un show

ues de anuncios individuales.

Source link

Actualidad

la RAM apunta a encarecerse todavía más

Durante años hemos aceptado que los móviles fueran subiendo de precio a cambio de mejores cámaras, mejores pantallas, procesadores más rápidos y diseños, por decirlo de alguna manera, cada vez más refinados. También hemos empezado a asumir que la IA integrada en el dispositivo no llega gratis: suele exigir más potencia, más almacenamiento y más memoria. La sorpresa es que uno de los próximos golpes puede venir precisamente de ahí, de la RAM móvil, un componente que suele pasar desapercibido, pero pero muy presente en el coste real de cada smartphone que llega al mercado.

La señal más clara llega desde la LPDDR5X, una de las memorias móviles más relevantes del mercado actual y que ya venía de un movimiento poco habitual. Según los datos de TrendForce, este tipo de memoria registró en el primer trimestre de 2026 una subida intertrimestral de entre el 58% y el 63%. Se trata del mayor incremento trimestral de su historia. Lo llamativo es que ese salto no parece haber cerrado el ciclo: la previsión para el segundo trimestre apunta a una escalada todavía más intensa.

Si nos enfocamos en la previsión para el segundo trimestre, cambia la escala del problema. Una proyección atribuida a TrendForce, compartida Jukan Choi, apunta a que los precios de contrato de la DRAM móvil crecerán entre un 93% y un 98% en términos intertrimestrales durante ese periodo. Dicho de otra forma: no hablamos de una subida más dentro de un mercado tensionado, sino de un salto cercano a duplicar el precio en apenas tres meses. Para la industria del smartphone, una cifra así no es ruido de fondo.

Cabe señalar que TrendForce trabaja con informes de pago dirigidos principalmente a inversores institucionales, analistas y compañías del sector, así que el documento completo no está disponible abiertamente. La parte relevante para este artículo ha trascendido a través de Choi, analista de semiconductores en Citrini Research. El experto acumula más de 100.000 seguidores en X y sus comentarios han sido citados por medios como The Economist, que los incluyó en un artículo sobre el impacto de la IA en la electrónica de consumo.

El impacto en el precio de la RAM en los teléfonos móviles

Aquí no estamos hablando del precio que ve un usuario cuando busca memoria en una tienda. La DRAM móvil se negocia en otro terreno: el de los contratos entre fabricantes de memoria, como Samsung, SK Hynix o Micron, y grandes clientes que compran enormes volúmenes para integrar esos chips en sus productos. Este mundo lo integran marcas de móviles, fabricantes de servidores y otros OEM. Por eso el dato importa: no describe una compra puntual, sino el coste base con el que la industria empieza a fabricar sus próximos dispositivos.

La subida tampoco aparece de la nada. SemiAnalysis apuntó a comienzos de abril de 2026 que los precios de la DRAM podrían más que duplicarse durante este año y volver a registrar otro incremento de doble dígito en 2027. La misma firma señalaba que el precio de contrato de la LPDDR5 había subido más de 3 veces desde el primer trimestre de 2025, y que probablemente superaba los 10 dólares/GB en el mercado abierto durante el primer trimestre de 2026. Es decir, el segundo trimestre no inaugura la tensión: la acelera.

Los precios de la DRAM podrían más que duplicarse durante este año y volver a registrar otro incremento de doble dígito en 2027.

El telón de fondo es la IA. La memoria HBM, clave para alimentar las GPU que sostienen muchos centros de datos de inteligencia artificial, sigue en una situación de escasez estructural y absorbe buena parte de la inversión del sector. La consecuencia es sencilla de entender: si buena parte del dinero, la capacidad productiva y la atención de los fabricantes se dirige a esa memoria de alto ancho de banda, queda menos margen para aliviar la tensión en otras familias de DRAM. Entre ellas está la memoria móvil, que ahora compite en una cadena de suministro mucho más exigida.

A eso se suma otro detalle importante: la memoria de clase smartphone ya no vive solo dentro del smartphone. NVIDIA utiliza LPDDR5X en sus procesadores Grace y Vera, diseñados para sistemas de servidor vinculados a IA. La lectura para el mercado móvil es clara: una tecnología utilizada en teléfonos y dispositivos compactos también forma parte de arquitecturas que compiten por recursos en el centro de la carrera por la inteligencia artificial.

La diferencia con el mundo del PC ayuda a entenderlo mejor. Si montamos un ordenador, podemos elegir cuánta RAM comprar, buscar una oferta e instalar el módulo nosotros mismos. Con los móviles no funciona así: compramos un dispositivo completo, con la memoria ya integrada y sin margen real para intervenir después. Eso hace que la subida de la LPDDR no se vea de forma directa, pero no significa que desaparezca. Queda incorporada al coste de fabricar el teléfono y, desde ahí, puede terminar influyendo en el precio que pagamos.

Counterpoint ayuda a convertir ese encarecimiento en una cifra mucho más fácil de visualizar. Para una configuración de gama alta, con 16 GB de LPDDR5X HKMG y 512 GB de almacenamiento UFS 4.1, la firma proyectaba un aumento del BOM de entre 100 y 150 dólares para el segundo trimestre de 2026. Hablamos del coste de materiales, no del precio de venta, así que no conviene trasladar esa cifra de forma mecánica al consumidor. Aun así, es una señal que no pasa desapercibida.

La mala noticia, por tanto, no es que todos los móviles vayan a subir de precio de forma automática ni en la misma proporción. Eso dependerá de cada fabricante, de sus contratos, de sus márgenes y de cómo configure cada gama. Pero el factor está ahí: si la memoria móvil se encarece con esta fuerza, el coste de fabricar un smartphone cambia inevitablemente. Y en un mercado que ya venía acostumbrándonos a precios cada vez más exigentes, la RAM se perfila como otro obstáculo para quienes esperaban una bajada de precios a corto plazo.

En Xataka | Apple había sido capaz de mantener precios pese a la loquísima subida de la memoria RAM. Eso se ha terminado

ues de anuncios individuales.

Source link

Actualidad

una vulnerabilidad acaba de sacudir casi todas sus versiones

Linux tiene fama de sistema robusto. No invulnerable, claro, pero sí especialmente resistente, hasta el punto de haberse convertido en una de las bases silenciosas de Internet, de los servidores empresariales y de muchos entornos donde la seguridad es parte del contrato. Por eso una vulnerabilidad como CopyFail resulta especialmente seria: no hablamos de un fallo menor en una aplicación aislada, sino de un problema en el kernel que puede permitir que alguien que ya ejecuta código con pocos permisos acabe obteniendo acceso root.

CopyFail. La vulnerabilidad, identificada como CVE-2026-31431, salió a la luz cuando la firma Theori hizo públicos los detalles del fallo y el código de explotación tras haber avisado cinco semanas antes al equipo de seguridad del kernel de Linux. Ese matiz temporal es importante porque el kernel ya había recibido parches en varias ramas, desde 7.0 hasta 5.10.254. Lo que no había ocurrido todavía, al menos de forma generalizada, era su traslado efectivo a muchas distribuciones Linux.

De qué estamos hablando. CopyFail es una escalada local de privilegios. No significa que cualquiera pueda atacar desde fuera una máquina Linux sin más, sino que alguien que ya puede ejecutar código dentro del sistema con permisos limitados, por ejemplo desde una cuenta normal, un servicio web comprometido, un contenedor o un trabajo de CI/CD, puede intentar escalar hasta root. En Linux, root es la cuenta con control administrativo completo. Por eso el riesgo no está en la primera puerta de entrada, sino en lo que ocurre justo después: un acceso acotado puede convertirse en control del sistema.

Un exploit demasiado fiable. Hay otro elemento que explica la alarma. Muchas vulnerabilidades del kernel dependen de condiciones muy concretas para funcionar, como una corrupción de memoria que puede variar según la versión, la distribución o incluso la máquina. CopyFail parte de un fallo lógico en la API criptográfica del kernel, y eso cambia el terreno. Los investigadores de Bugcrowd explican que al tratarse de un fallo lógico, el exploit no depende de ajustes internos tan específicos, un rasgo que reduce la fricción para los atacantes y complica el trabajo de los defensores.

El parche. El caso también deja una lección sobre cómo se coordinan las vulnerabilidades en Linux. Como mencionamos arriba, Theori comunicó el fallo al equipo de seguridad del kernel cinco semanas antes de darlo a conocer públicamente. El problema es que, para la mayoría de los usuarios, las correcciones no llegan directamente, sino a través de distribuciones que empaquetan, prueban y publican sus propios parches o mitigaciones. Cuando el exploit se hizo público, ese proceso aún no había terminado en muchas distribuciones o versiones, dejando una ventana de exposición difícil de ignorar.

Situación actual. Con los días, parte del ecosistema ha empezado a cerrar la brecha, pero no de una forma uniforme. Al momento de publicar este artículo, distribuciones como Debian, Arch, Fedora, SUSE y Amazon Linux ya habían publicado parches o avisos para determinadas ramas, mientras que Ubuntu insistía en actualizar el sistema y aplicar mitigaciones si el kernel corregido aún no estaba disponible o no se había cargado tras un reinicio.

Imágenes | Xataka con Nano Banana

ues de anuncios individuales.

Source link

Actualidad

Anthropic acaba de dejar atrás el mayor lastre de Claude. Lo ha conseguido tras sellar una alianza con SpaceX de Elon Musk

Hay pocas cosas más frustrantes que encontrar una herramienta que encaja casi exactamente con lo que necesitamos y descubrir, justo cuando empezamos a sacarle partido, que no podemos seguir usándola al mismo ritmo. Claude se ha ganado un lugar destacado entre quienes usan la inteligencia artificial para programar, analizar documentos o trabajar con tareas exigentes, pero también ha arrastrado una queja muy concreta: sus límites de uso. No hablamos de una molestia menor, sino de una fricción capaz de romper el flujo de trabajo.

Anthropic ha decidido atacar el problema. La compañía liderada por Dario Amodei anunció una subida de los límites de Claude Code y de la API de Claude, apoyándose en una nueva alianza con SpaceXAI. El pacto le dará acceso a Colossus 1, una infraestructura que Anthropic presenta como una vía para mejorar directamente la experiencia de sus usuarios más intensivos. La promesa, por ahora, es clara: más margen para usar Claude sin que la demanda le pase factura tan rápido.

La tensión con los límites. El ajuste que ayuda a entender esta noticia llegó unas semanas antes. Anthropic modificó recientemente sus límites temporales para gestionar mejor la demanda durante las horas punta. En la práctica, eso significaba que las sesiones de cinco horas podían consumirse antes de que pasaran esas cinco horas reales si el uso se producía en las franjas de mayor demanda. El cambio afectaba especialmente a quienes hacían un uso más intenso de Claude.

Más margen para usar Claude. Anthropic concreta la mejora en tres cambios que, según la compañía, entran en vigor inmediatamente. El primero es la duplicación de los límites de cinco horas de Claude Code para los planes Pro, Max, Team y Enterprise por asiento. El segundo es la eliminación de la reducción de límites en horas punta para Claude Code en las cuentas Pro y Max. El tercero afecta a la API: Anthropic asegura que ha elevado de forma considerable los límites de uso para los modelos Claude Opus, aunque el alcance exacto depende de la tabla de límites publicada por la propia compañía.

El músculo de Colossus 1. El acuerdo con SpaceXAI es la pieza más llamativa del anuncio porque Anthropic asegura que podrá usar toda la capacidad de cómputo del centro de datos Colossus 1. Según la compañía, eso supone más de 300 megavatios de nueva capacidad y más de 220.000 GPU NVIDIA que estarán disponibles en el plazo de un mes. SpaceXAI también detalla que el clúster incluye despliegues de H100, H200 y aceleradores GB200.

La transformación continúa. SpaceXAI no aparece en este acuerdo como una simple etiqueta nueva dentro del ecosistema de SpaceX. El contexto, Elon Musk señaló que “xAI se disolverá como compañía independiente” y que sus productos de inteligencia artificial pasarán a integrarse bajo SpaceXAI. La frase ayuda a entender por qué Anthropic habla de esta marca al explicar su nuevo acceso a capacidad de cómputo. Eso sí, para evitar confusiones, lo anunciado por Anthropic no es una compra ni una fusión, sino un acuerdo para usar infraestructura de IA.

No es un acuerdo aislado. Anthropic también quiso enmarcar la alianza con SpaceXAI dentro de una estrategia de capacidad mucho más amplia. La compañía recuerda un acuerdo de hasta 5 GW con Amazon, que incluye casi 1 GW de nueva capacidad para finales de 2026, y otro pacto de 5 GW con Google y Broadcom que empezará a entrar en funcionamiento en 2027. A eso suma una alianza estratégica con Microsoft y NVIDIA, con 30.000 millones de dólares de capacidad en Azure, y una inversión de 50.000 millones de dólares en infraestructura de IA en Estados Unidos con Fluidstack.

La parte más futurista. El acuerdo también incluye una derivada mucho más especulativa. Anthropic afirma que, como parte del pacto, ha expresado interés en colaborar con SpaceXAI para desarrollar varios gigavatios de capacidad de cómputo orbital. SpaceXAI lo presenta como una posible respuesta a la presión que la IA está ejerciendo sobre la energía, el suelo y la refrigeración en tierra, pero por ahora estamos lejos de algo tangible. Eso sí, esa vía solo tendría sentido si antes se superan importantes retos de ingeniería.

El reto real. Anthropic ha puesto sobre la mesa una respuesta directa a una de las grandes quejas alrededor de Claude, aunque todavía falta la parte más importante: comprobar cómo se nota en el uso real. Los nuevos límites y la capacidad adicional de SpaceXAI parecen apuntar en la dirección correcta para quienes trabajan de forma intensiva con estos servicios. La mejora, por tanto, abre una nueva fase: la de comprobar si Claude puede ofrecer más margen sin que sus usuarios vuelvan a encontrarse demasiado pronto con el mismo muro.

Imágenes | Xataka con Nano Banana

ues de anuncios individuales.

Source link

-

Deportes2 días ago

Deportes2 días agoMuere Eduardo Lamazón, comentarista de boxeo, a los 70 años de edad | Video

-

Deportes2 días ago

Deportes2 días agoLiga MX: Cristian Borja, defensa colombiano de América, sufre una lesión en la rodilla derecha | Video

-

Tecnologia2 días ago

Tecnologia2 días ago¿Qué es el hantavirus, brote que afecta a un crucero de expediciones?

-

Tecnologia1 día ago

Tecnologia1 día agoExposición a contaminación conlleva un aumento de grasa corporal, revela estudio

-

Tecnologia1 día ago

Tecnologia1 día agoONU advierte de la posibilidad de una pandemia digital, ¿qué la causaría?

-

Tecnologia1 día ago

Tecnologia1 día agoDetectan 10 sitios falsos de boletos para BTS en México

-

Musica1 día ago

Musica1 día agoJunior H volverá a Guadalajara en 2027 tras suspensión de su concierto

-

Deportes1 día ago

Deportes1 día agoChampions League: Alistan bávaros y parisinos su artillería para la batalla final en el Allianz Arena | Video